國

立

交

通

大

學

多媒體工程研究所

碩

士

論

文

基 於 異 質 攝 影 機 整 合 之 智 慧 型 監 控 系 統

Intelligent Surveillance System Based on Integration of

Heterogeneous Cameras

研 究 生:林尚一

指導教授:莊仁輝 教授

基於異質攝影機整合之智慧型監控系統

Intelligent Surveillance System Based on Integration of Heterogeneous

Cameras

研 究 生:林尚一 Student:Shang-Yi Lin

指導教授:莊仁輝 Advisor:Jen-Hui Chuang

國 立 交 通 大 學

多 媒 體 工 程 研 究 所

碩 士 論 文

A ThesisSubmitted to Institute of MultimediaEngineering College of Computer Science

National Chiao Tung University in partial Fulfillment of the Requirements

for the Degree of Master

in

Computer Science

June 2009

Hsinchu, Taiwan, Republic of China

基於異質攝影機整合之智慧型監控系統

學生:林尚一 指導教授:莊 仁 輝 博士

國立交通大學

多媒體工程研究所碩士班

摘 要

在智慧型監控應用中,不同的攝影機有不同的優缺點,一般的可見光攝影機 會受到環境的影響,在光源不足的地方無法清楚地辨識出環境中是否有可疑人物。 經常使用於夜間的近紅外線攝影機由於是主動式打光,可偵測的距離有限。中紅 外線攝影機雖然可不受環境影響清楚辨識場景中的高溫人物,但背景較模糊且價 格昂貴。本論文將以整合兩種性質不同的攝影機為目的,提出兩個分別在日間與 夜間使用之監控系統。前者利用可見光與中紅外線攝影機偵測可見光影像中是否 有無法辨識的可疑人物,若有則發出警訊,並且會在可見光影像中畫出此人物之 近似輪廓。而後者則使用近紅外線與中紅外線攝影機動態拍攝,並利用夜間環境 中預先架設好的近紅外線 LED 當作地面定位參考點,對環境中高溫物體進行定 位。Intelligent Surveillance System Based on

Integration of Heterogeneous Cameras

Student:Shang-Yi Lin Advisor:Dr. Jen-Hui Chuang

Institute of Multimedia Engineering

National Chiao Tung University

ABSTRACT

Different types of camera have different advantages and disadvantages for intelligent surveillance applications. Visible cameras cannot correctly recognize suspicious humans when the illumination is insufficient. Near-infrared cameras, which are often used the nighttime and illuminate the environment by LEDs, usually have limited depth of view. Mid-infrared cameras can correctly recognize objects of high temperature in different environments, but the background of the image can be blurred, and the price of camera is high. In this thesis, by integrating heterogeneous cameras, we propose two systems for daytime and nighttime surveillance, respectively. In the daytime system, a visible camera and a mid-infrared camera are used. When the visible camera cannot recognize an object correctly due to low illumination, an approximate outline will be drawn using the data from another camera, and a warning message will be issued. In the nighttime system a near-infrared camera and a mid-infrared camera are used. The system will locate the objects of high temperature using near-infrared LEDs with known positions on the floor.

致謝

本論文得以順利完成,首先必頇要感謝我的指導教授莊仁輝老師。因為老師 在研究上的耐心教導,讓我對研究的領域更加了解;在生活上的叮嚀及勉勵,更 成為我未來生活的助力。再者必頇要感謝三位口詴委員,雷欽隆教授、蔡文祥教 授、及顏嗣鈞教授的建議及指導,讓本論文的內容更加完整、更加充實。 謝謝實驗室的所有伙伴,尤其是同屆的世旻、聖中、宣良、永昌與邦展。由 於大家的相互扶持及鼓勵,使得大家得以一起順利畢業。也謝謝學弟妹及學長姐 們,由於你們帶給大家的歡樂,使得實驗室的氣氛一直很和樂,也因此使得在研 究的生活並不會孤單及煩悶。在此要特別感謝泓宏及國華學長,在我程式及學習 上有任何問題時,你們總是不吝惜的指導,讓我在研究上可以更上一層樓。 謝謝所有資科 96 的伙伴,從大學以來大家的一同學習,每年節日的聚會, 凝聚了一股令人稱羨的向心力。也要特別謝謝宸德、宗寰、庭緯、家欣等同學在 生活上的陪伴及學業上的切磋。 最後,感謝一直以來支持我、為我操心的家人,以及所有幫助過我的朋友們, 僅以此篇表達我誠摯的謝意。目錄

中文摘要...II 英文摘要...III 致謝...IV 目錄...V 圖目錄...VII 第一章 緒論...1 第二章 相關研究...3 第三章 多攝影機的前景影像對位系統...7 3.1 取得影像來源...9 3.2 前景背景分割...93.2.1 以 Gaussian mixture model 分割前景背景...10

3.2.2 消除雜訊與填補前景物細縫...11 3.3 尋找影像中的目標物...12 3.4 座標轉換...14 3.5 影像對位結果顯示方法...16 3.6 誤差調整...18 3.6.1 調整座標轉換矩陣...18 3.6.1 偵測分裂的目標物...20 3.7 偵測辨識不清的目標物及資訊彌補...22 第四章 基於異質攝影機之目標物定位...24 4.1 系統建置...25 4.2 取得目標物位置...28 4.2.1 以溫度等高線圖演算法得到完整目標物...29 4.2.2 取得目標物在影像中與地板的交界點...30 4.3 目標物定位...32 4.3.1 以環境空間座標系為中心之平面轉換定位方法...33 4.3.2 以攝影機座標系為中心之平面轉換定位方法...33 4.4 判斷影像中的定位特徵點位置...36 4.5 結果顯示方法...39 第五章 實驗結果...40 5.1 前景影像對位的結果探討...40 5.2 目標物定位的結果探討...44 5.2.1 減少定位誤差的方法...45 5.2.2 目標物定位的結果分析...48 第六章 結論...52 6.1 結論...52

6.2 未來展望...52 References...54

圖目錄

圖 2-1. 文獻[3]中做線段比對的例子。...5 圖 2-2. 文獻[4]中做直線比對的例子。...5 圖 2-3. 文獻[5]中利用線段組成的平面做特徵比對的例子。...6 圖 2-4. 文獻[6]中利用物體做特徵比對的例子。...6 圖 2-5. 文獻[7]中影像融合的結果。...6 圖 3-1. 可見光與中紅外線影像的差別。...8 圖 3-2. 紅外線影像轉換至可見光影像座標流程圖。...8 圖 3-3. 影像對位系統中取得的影像。...9 圖 3-4. 可見光與中紅外線影像的前景、背景分割結果。...11 圖 3-6. 侵蝕演算法的例子。...12 圖 3-7. 擴張演算法的例子。...12 圖 3-8. 為圖 3-4 的可見光影像之前景做侵蝕擴張後的結果。...12 圖 3-9. 元件連通物件法的例子。...13 圖 3-10. 元件連通物件法依水平線掃描的結果。...13 圖 3-11. 元件連通物件法完成的結果。...14 圖 3-12. 圖 3-4 的中紅外線影像之前景利用元件連通物件法得到的結果。...14 圖 3-13. 由目標物計算出 PCA 的座標示意圖。...16 圖 3-14. 座標轉換的例子。...16 圖 3-15. 中紅外線影像的目標物轉換到可見光影像的結果。...17 圖 3-16. 中紅外線與可見光目標物的輪廓。...17 圖 3-17. 中紅外線影像的輪廓轉換到可見光影像的結果。...18 圖 3-18. 另一組影像的轉換結果。...18 圖 3-19. 做調整座標轉換矩陣前後的轉換結果。...20 圖 3-20. 時間 t-1 與 t 的可見光目標物。...21 圖 3-21. 為圖 3-20 兩影像的重疊區域。...21 圖 3-22. 以不同方法取得的目標物其區塊之廓。...21 圖 3-23. 有許多雜點的前景、背景分割結果。...21 圖 3-24. 因雜點影響的轉換結果。...22 圖 3-25. 無法清楚辨識目標物的可見光影像與對應之中紅外線影像。...23 圖 3-26. 系統發出警訊並做資訊彌補之結果圖。...23 圖 4-1. 目標物定位系統流程圖。...25 圖 4-2. 實驗環境外觀。...26 圖 4-3. 地面上的發熱物體與人的足部。...27 圖 4-4. 場景配置圖。...27 圖 4-5. 攝影機拍攝的起始影像。...28 圖 4-6. 中紅外線影像與其前景、背景分割結果。...29圖 4-7. 以較低的閥值進行前景、背景分割的結果。...29 圖 4-8. 以溫度等高線圖演算法找出的前景。...30 圖 4-9. 目標物的站立點位置。...31 圖 4-10. 雙腳倂攏時的站立點位置。...32 圖 4-11. 用區域最低點演算法所找到的站立點。……...32 圖 4-12. 目標物的特整點與在環境空間座標的位置。...33 圖 4-13. 有一個定位特徵點被目標物遮蔽的影像。...35 圖 4-14. 有三個定位特徵點共線的影像。...35 圖 4-15 . 環境空間座標系與攝影機座標系。...35 圖 4-16. 影像中有三個定位特徵點共線時目標物定位的結果。...35 圖 4-17. 把場景配置圖的定位特徵點進行編號。...37 圖 4-18. 各新增以及消失有一個定位特徵點的情況。...38 圖 4-19. 其中一個定位特徵點被遮蔽的情況。...38 圖 4-20. 攝影機在影像中的虛擬位置。...38 圖 4-21. 顯示較多資訊的結果圖。...39 圖 5-1. 目標物剛出現在畫面中的影像。...41 圖 5-2. 目標物完整出現在影像中時的轉換結果。...41 圖 5-3. 即將判斷目標物消失前的轉換結果。...42 圖 5-4. 判斷目標物消失瞬間的轉換結果。...42 圖 5-5. 判斷目標物消失一陣子後的轉換結果。...42 圖 5-6. 中紅外線影像目標物轉換至可見光後的重疊比率。...43 圖 5-7. 第 181 影格的轉換結果。...43 圖 5-8. 第 241 影格的轉換結果。...43 圖 5-9. 第 263 影格的轉換結果。...43 圖 5-10. 另一組影像的中紅外線影像目標物轉換至可見光後的重疊比率。...44 圖 5-11. 影像對位因雜訊造成的誤差結果。...44 圖 5-12. 以區塊質心作為定位特徵點位置的定位結果。...45 圖 5-13. 以區塊的外接矩形中心作為定位特徵點位置的定位結果。...46 圖 5-14. 以區塊平均亮度中最亮的 n 個點作為定位特徵點位置的定位結果。...46 圖 5-15. 加入時間資訊,以區塊質心計算定位果。...47 圖 5-16. 加入時間資訊,以區塊平均亮度中最亮的 n 個點計算定位結果。...48 圖 5-17. 擺放在地上的發熱物體。...49 圖 5-18. 攝影機不動時的目標物定位結果。...49 圖 5-19. 目標物在環境空間的座標。...49 圖 5-20. 目標物的站立點。...50 圖 5-21. 攝影機旋轉時目標物的定位結果。...50 圖 5-22. 第 77 影格的影像。...51 圖 5-23. 第 86 影格的影像。...51

第一章 緒論

過去我們所使用的監控系統是僅僅架設幾台類比攝影機在重要的區域,並雇 用保全人員監控這些畫面,並以磁帶等裝置紀錄影片內容。現今科技的發展,數 位監控攝影機正漸漸取代類比攝影機,傳統的紀錄媒介也從磁帶改變為硬碟。隨 著攝影機成本的降低,與夜間監控的發展,現在的安全監控系統已可廣泛架設可 見光與近紅外線攝影機於監控的設施中,像是住家、大樓、學校等,並透過影像 處理的技術先對監控的影像做處理,讓保全人員能專注在可能有安全性問題的畫 面上。 在許多安全監控的場合中,經常會因為環境的因素造成目標物無法被清楚地 拍攝,像是在光線不足的環境中常常無法準確地辨識目標物的特徵。但安全監控 是要求精確以及穩定的應用,若是會受到環境的影響而產生誤差,則安全監控的 系統將無法被人們所信任與採用。因此避免因環境的影響而產生誤差的常見解決 方法就是使用紅外線攝影機,因為近紅外線攝影機是主動對拍攝的場景打光,而 中紅外線攝影機式偵測物體所發出的紅外線波長,因此較不容易受到環境中可見 光的影響,可以使得監控系統有更加穩定之表現。 而在夜間監控環境中,近紅外線因為是主動式打光,所拍攝的距離會因用來 打光的燈泡強弱而有所改變,物體距離攝影機太近時會產生過度曝光,太遠則會 有光線不足的問題。而中紅外線攝影機價錢昂貴,只能設置在重要區域進行監控, 若是可以在進行動態拍攝時進行監控,則能增加拍攝區域,減少監控系統的死 角。 安全性監控除了使用單一光源攝影機之外,影像融合可以將不同特性影像的 資訊加以結合,並彼此彌補其中單一光源的影像資訊不足的部分。可見光影像即 為人類的視覺平常看到的畫面,影像上的色彩資訊較多,但是容易受到環境光源 變化的影響。近紅外線影像由於攝影機是主動式打光,不容易受到環境的影響,除了拍攝距離有所限制之外,拍攝出的畫面是灰階影像,雜訊也較可見光影像多。 中紅外線影像是直接偵測環境中的物體所發出的紅外線波長,也就是物體的溫度, 因此不容易受到環境的影響,雖然影像中的物體可以很明顯的辨別出來,但相對 的卻不容易看出背景的環境(例如背景在場景中的位置)。而要結合兩邊影像的資 訊之前,必頇先找出兩種影像的空間對應關係。一般的常見作法都是用影像來做 分析,以便在不同影像間尋找特定物體的對應,或是找出不同影像之間的座標轉 換。利用兩攝影機影像之間座標轉換的關係,把其中一邊的資訊轉換到另一邊的 影像中,再做進一步的處理已彌補資訊不足的部分。 本研究將利用一台兼具可見光與近紅外線的攝影機和中紅外線攝影機來尋 找不同特性影像間特定物體的對應,再利用此對應關係進行影像對位與座標定位, 以彌補特定影像中資訊不足的問題。

第二章 相關研究

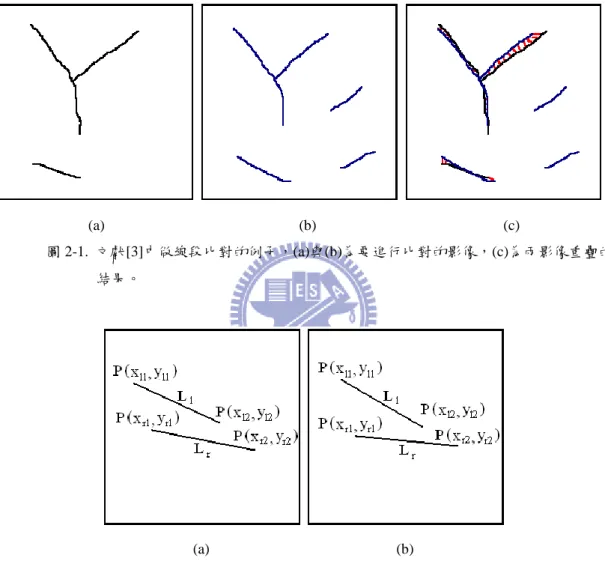

常見的影像間資訊融合有兩種作法,(1)利用影像中的特徵,找出影像間的 轉換關係以進行影像融合,(2)不以影像的內容求出影像間的轉換關係,而是用 其他器材的資訊進行影像融合。(1)的作法中,一項很重要的工作就是找出兩邊 影像間對應的特徵,常見的特徵對應中有利用特定像素做為特徵進行對應,像是 SIFT[1],是從整張影像中取得每個像素的 DOG(difference of Gaussian),找出 DOG 較大的像素做為特徵,再進行兩邊影像的比對(match)。使用 SIFT 可以由其中一 邊的目標物上的特徵找出另一邊影像是否有對應的目標物,但由於是此方法是像 素與像素之間的對應,必頇找出兩影像間所有目標物特徵與另一邊影像的對應關 係都有相同的向量,才算是找到對應的目標物。文獻[2]是找出受到仿射轉換的 影像間之對應,先找出影像中的邊界,接著計算邊界中曲率較大像素作為角點, 計算兩邊影像中具有最小曲率差的三個角點配對,利用這三個點對應算出一仿射 轉換關係,對其他角點進行轉換,計算轉換後的其他角點與另一張影像中的角點 間之差距,若差距不大就算是找到兩影像間對應的關係,否則就丟棄這組角點配 對關係,找出下一組具有最小曲率差的三個角點配對,直到找到兩影像間的對 應。 另外常見的物體對應有利用影像中的線段做比對,文獻[3]是做線段比對, 假設有兩張影像中的線段要尋找對應關係(圖 2-1 的(a)和(b)),先把兩張影像重疊, 重疊後的結果為圖 2-1(c),可以明顯地看出線段之間的對應關係。再以線段上的 端點所形成之集合做為 line feature,找出兩個影像中的 line feature,以集合數量 較少的影像為基準,與另一邊影像中的集合比對,用集合中的點計算距離,找出 距離最近的集合。因為每個點都要計算過,所以假設兩個集合分別有 m, n 個點, 因此頇要算 O(m*n)次的距離,時間複雜度太高。文獻[4]這篇會從影像中找出直 線並計算特徵,以圖 2-2 為例,左邊影像的 Ll, Lr分別對應到右邊影像的 Ll, Lr。

在比對線段時,會先計算三個參數再做比對,分別是兩個線段在 x 軸(或 y 軸)的 重疊部分、線段的長度比(較短線段長度除以較長線段長度)、兩條線段的夾角, 再利用這三個參數乘以特定的比重後,用一閥值來判斷其中一邊影像的線段是否 有對應到另一邊影像的線段。 也有使用影像中的平面來比對,文獻[5]先找出影像中物體的邊線,並將這 些邊當作特徵,然後把互相有連結的邊連起來,最後會合成一些平面。如圖 2-3, 影像中的物體用許多的線段來代表它們的輪廓,相鄰的線段被連起來時就有機會 形成一個面。若是有一個面可以包住其他的面,它們也會變成一個集合,其中每 個集合紀錄特徵數量和佔用的面積等資訊,接著利用這些資訊來比對兩邊影像中 的集合,再以集合中的面等特徵做比對,盡量找出影像中每個特徵與另一邊影像 中特徵的對應。 更進一步的有直接拿整個物體做比對的方法,文獻[6]是做物體的對應,先 有一張要進行比對的影像當作是原圖(如圖 2-4(a)),再從其他影像中尋找是否有 與原圖相似的圖形,此方法可以找出與原圖十分相似且受到仿射轉換而變形的其 他圖形(如圖 2-4(b)(c))。這個方法會先取得原圖的輪廓,用輪廓上的點做傅立葉 轉換,再利用傅立葉轉換後的結果進行複雜的運算,找出在頻率空間中不會受到 旋轉、縮放、平移等影響的不變量當作物體特徵,以進行物體的對應。這些方法 都有共同的特徵,就是如果要找出物體間的對應關係,必頇先擷取出物體的特定 資訊再加以比對。 而(2)的作法中,有像是[7]利用校正攝影機的位置來達到影像融合。文獻[7] 所呈現的結果與本論文十分接近,都是利用兩台性質不同的攝影機(紅外線與可 見光)以彌補其中一邊影像中資訊不足的部分。此方法必頇先把攝影機的位置校 正完整,才能進行即時資訊融合的影像呈現,但兩台攝影機的擺設位置受到很多 限制,並且與拍攝物體之間的距離也有所限制,才能進行精確資訊融合。首先能 在兩邊影像中進行精確轉換的場景限制在一個與攝影機拍攝方向垂直的平面上, 攝影機水平方向要對齊,且紅外線攝影機的高度必頇在可見光攝影機視野的頂端。

圖 2-5 為此方法的結果,使用者可選定一個特定區塊讓紅外線影像與可見光影像 進行資訊融合,可以看出人體因為溫度較高,所以區塊中的人體部分比較亮,與 區塊外的人體部分也沒有斷層,但仔細觀察可以發現影像下方的垃圾桶因為與人 在不同平面,所以出現了斷層。 (a) (b) (c) 圖 2-1. 文獻[3]中做線段比對的例子,(a)與(b)為要進行比對的影像,(c)為兩影像重疊的 結果。 (a) (b) 圖 2-2. 文獻[4]中做直線比對的例子,(a)與(b)為要進行比對的影像。

(a) (b) 圖 2-3. 文獻[5]中利用線段組成的平面做特徵比對的例子,(a)與(b)為要進行比對的影像。 (a) (b) (c) 圖 2-4 (a)為要比對的原圖,(b)為圖(a)選轉後縮放的結果,(c)與圖(a)的圖案有一點不同並 且做水平鏡射處理。 圖 2-5. 文獻[7]中影像融合的結果。

第三章 多攝影機的前景影像對位系統

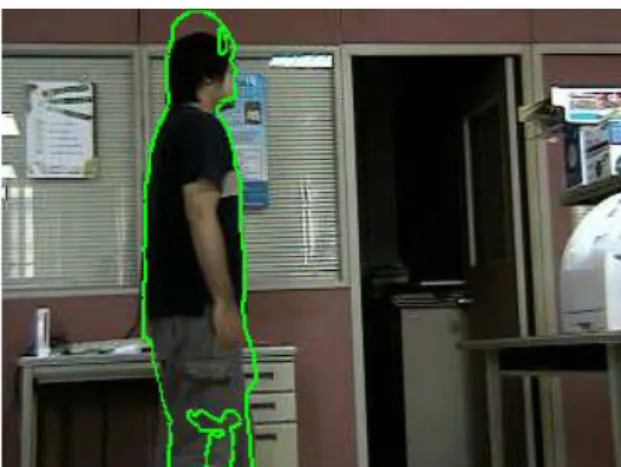

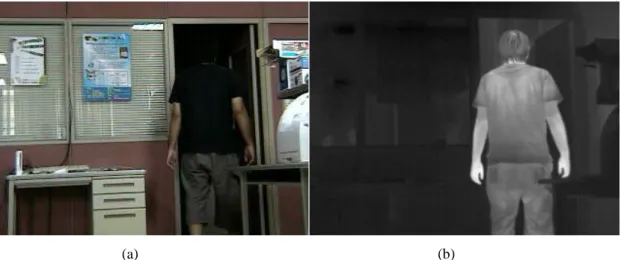

在一般安全監控的環境中,有時候會遇到一些光線不足的區域,若是有人物 在那些區域出沒,則一般的可見光攝影機很難分辨出人物的位置(如圖 3-1(a)), 然而若是使用中紅外線攝影機則可以清楚地看見人物,但卻不容易分辨人物所在 的環境及背景(如圖 3-1(b))。因此本論文提供一個影像對位的方法,利用紅外線 影像彌補可見光影像中目標物不清晰的問題,當目標物在可見光影像中無法被辨 識時會發出警告,並標出目標物的位置,我們假設利用中紅外線影像能穩定地辨 識出目標物,以便用中紅外線影像的資訊。 圖 3-2 為影像對位方法的流程圖,我們在此先簡單地介紹把紅外線影像轉換 至可見光影像系統的步驟,細節部分將在下面的其他章節做介紹。整個系統的流 程中先同時從可見光和紅外線攝影機取得影像,接著做前景、背景分割找出目標 物後,若是有之前的目標物資訊則可進行目標物再偵測,以增加目標物偵測的準 確性。有了目標物後,便進行目標物資訊的分析,找出目標物的特徵。若是有可 見光目標物,則可利用可見光與紅外線目標物的特徵求出兩個影像平面之間的轉 換矩陣,並做轉換和調整誤差以顯示結果。最後再進行儲存資訊以便在下一張影 像進行目標物偵測時增加判斷的精準度。若是沒有可見光目標物,則使用之前的 轉換矩陣把紅外線影像的目標物轉換到可見光影像中,再回到一開始的步驟取得 下一張影像。(a) (b)

圖 3-1. 可見光與中紅外線影像的差別,(a)可見光影像,(b)紅外線影像。

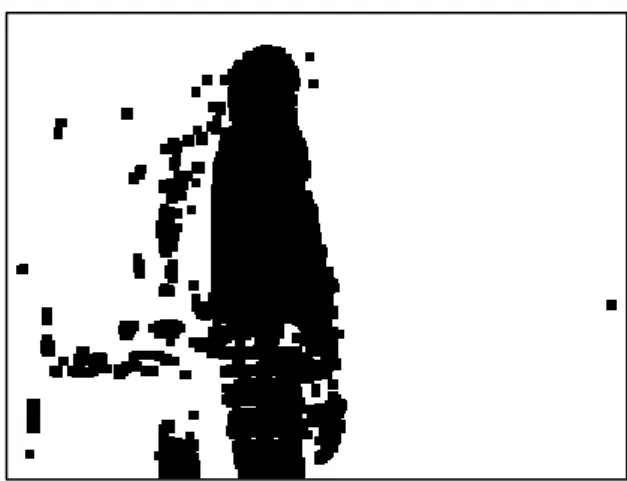

3.1 取得影像來源 本研究利用紅外線攝影機和可見光攝影機,朝同樣的目標物體拍攝出紅外線 影像和可見光影像(如圖 3-3),並且利用兩邊影像特徵相似的部分做比對。其中 紅外線攝影機所拍攝的影像中每一個像素以 16bits 表示其代表的溫度,為了方便 觀察我們把影像中所有的像素值縮放到 0 至 255,也就是灰階影像來表示。實驗 時假設兩台攝影機相距很近,意即射影機所拍攝的場景不會差距太大,這是因為 做資訊融合必頇要由影像中場景相同的部分來進行,也就是要以相同的場景部分 找出兩影像間的轉換關係。 (a) (b) 圖 3-3. 影像對位系統中取得的影像,(a)紅外線影像,(b)可見光影像。 3.2 前景背景分割 對於從攝影機取得的影像,我們要先找出影像中感興趣的部分。3.2.1 節我 們說明 Gaussian mixture model (GMM)對可見光影像進行前景、背景分割的方法, 而對紅外線影像(如圖 3-4(c))則是設定一個閥值,找出影像中高溫的物體做為前 景(如圖 3-4(d))。3.2.2 節我們介紹消除前景、背景分割結果的雜訊以及填補前景 細縫的方法,之後系統再使用影像中的前景進行進一步的分析與處理。

3.2.1 以 Gaussian mixture model 分割前景背景

本論文利用文獻[8]的 Gaussian mixture model 演算法,把可見光影像中的前 景背景分開。GMM 對可見光影像建立背景模型以判斷影像中的像素是否為背景, 其實作方法是將影像中的每個像素都用數個高斯模型來代表可能是背景的顏色 值。高斯模型可以用三個參數來代表,分別是

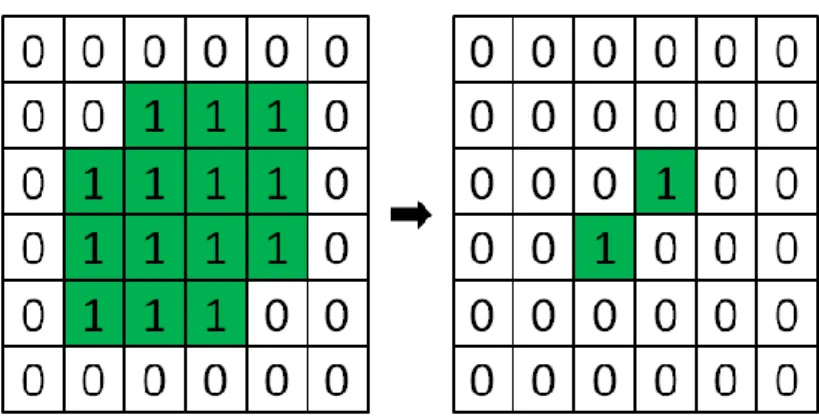

、

、

,

為高斯模型的平 均顏色值,

為高斯模型的標準差(standar deviation),

為高斯模型的權重,

越大代表此像素位置的像素顏色值較常屬於此高斯模型。當有新的影像進來的時 候,把每個新進影像中像素的顏色值與背景模型中與該像素同樣位置的數個高斯 模型依下式做比較, 2 2 * 5 . 2 ) (it (3.1) 其中 i 為像素的顏色值,t 代表時間點 t,當式(3.1)成立時,就判斷此像素為屬於 此高斯模型。 當此高斯模型的權重大於某個 threshold 時,則判斷此高斯模型屬於背景模 型,屬於此高斯模型的像素也就被判斷成背景。對於不屬於任何高斯模型的像素 或是其所屬之高斯模型不屬於背景模型時,該像素就會被判斷為前景。判斷完新 進影像的像素是否為背景後就要更新高斯模型,當像素屬於某個高斯模型,則代 入式(3.2)、式(3.3)和式(3.4)更新高斯模型的

、

、

等參數 1 ) 1 ( , 1 ,t kt k (3.2) t t t

i

(1 ) 1 (3.3) 2 2 1 2 ) ( ) 1 ( t t t t i (3.4) 其中

、

為指定的更新速度。若像素不屬於任何一個高斯模型,則直接用像 素的顏色值當作高斯模型的

取代

最小的高斯模型。圖 3-4(b)為可見光影像 (圖 3-4(a))以 GMM 切割出的前景,影像中的雜訊,或是人物的顏色與背景相似 時都會影響切割的結果。(a) (b) (c) (d) 圖 3-4. 可見光與中紅外線影像的前景、背景分割結果, (a)可見光影像,(b)使用 GMM 偵測到 的前景物體,(c)紅外線影像,(d)使用一個閥值偵測到的前景物體。 3.2.2 消除雜訊與填補前景物細縫 可見光影像經由 GMM 演算法切割出前景、背景後,會發現前景物很容易有 一些細碎的雜點(如圖 3-4(b)),我們利用侵蝕擴張(erosion & dilation)演算法,把 雜訊去除以及補滿前景的細縫。侵蝕是把前景物與背景相鄰的邊界消去,如圖 3-6,其中 0 代表背景、1 代表前景物,當一個前景物像素的周圍 8 格中有一格是 背景區域時該像素就會被歸類成背景。而擴張則是與侵蝕相反,與前景物相鄰的 背景像素會被取代成前景(如圖 3-7)。把圖 3-4(b)前景背景分割出的結果使用侵蝕 擴張演算法先侵蝕兩次再擴張兩次可得到圖 3-8 的結果,可以看出細碎的雜點有 被濾除,前景物的細縫也有被補起來。

圖 3-6. 侵蝕演算法的例子。 圖 3-7. 擴張演算法的例子。 圖 3-8. 為圖 3-4(b)做侵蝕擴張後的結果。 3.3 尋找影像中的目標物 得到清除雜點及補滿前景細縫後的前景、背景分割圖後,利用元件連通物件 法(connected component)方法找出擁有最大區域的前景物體當作是目標物。元件 連通物件法可以找出影像中相連的區域如圖 3-9,首先以水平線的方向掃描整張 影像,若是找到一個還未被標記的前景物則用一個新的數字標記起來,並在周圍

3*3 的區域尋找是否有前景區域。若是找到還未標記的前景,則把它標記成同樣 的數字,若是找到不同的標記數字,則建立一個查詢表記下這兩個標記數字是連 在一起的。圖 3-9 在上述掃描過程完成後就會有圖 3-10 的結果,可以發現仍有 不同編號連再一起的情況。再利用查詢表重新標記一次數字,就可以得到圖 3-11 的結果。 輸入圖 3-12 為使用物件連通法區分不同區域的結果,我們把不同區域分別 以不同顏色代表,以利觀察分群的結果。有了元件連通物件法的結果就可利用標 記的數字輕易計算出每個前景區域的面積,再找出最大面積的區域當作目標物。 圖 3-9. 元件連通物件法的例子,1 代表前景,0 代表背景。 圖 3-10. 元件連通物件法依水平線掃描的結果,會有不同編號連在一起的情況。

圖 3-11. 元件連通物件法完成的結果。 圖 3-12. 圖 3-4(d)利用元件連通物件法得到的結果。 3.4 座標轉換 在得到目標物後,我們需要從目標物區塊中得到能代表目標物的資訊。目標 物的特徵除了面積、質心之外,我們使用文獻[9]所提出之 principal components analysis (PCA)分析目標物的特徵當作目標物的特徵之一,由目標物的特徵求出兩 邊影像間的轉換關係。 首先算出影像中目標物區塊的質心位置,假設目標物的質心座標為(Xm,Ym)。 然後求出目標物區塊內所有資料點間關係的共變異數矩陣(covariance matrix),關 連矩陣就如式(3.5)所示。

m i m i m i m i m i m i m i m i m i m i m i m i Y y Y y Y y X x Y y X x X x X x CovMatrix 1 1 1 1 )] )( [( )] )( [( )] )( [( )] )( [( (3.5) 最後利用特徵向量分解(eigenvector decomposition),求出此共變異數矩陣的特徵向量(eigenvector)和特徵值(eigenvalue)當作目標物特徵的一部分。

經由分析目標物的特徵資訊後,我們把 PCA 算出來的特徵向量中,特徵值 較高(低)的向量當作新的 x 軸(y 軸)向量並以物體質心為原點,藉由紅外線和可見 光影像中的目標物,可分別定義兩個新的 x 軸座標軸 xir和 xvis,並假設影像的 x 座標軸為 xorig。圖 3-13 為中紅外線與可見光影像畫上 xir、xvis及 xorig座標軸的示 意圖,可以發現兩 xir與 xvis座標軸之間有平移、旋轉、縮放的差異。為了方便說 明我們以圖 3-14 為例,綠色區塊的圖形為目標物,紅色的座標軸分別為 xir與 xvis。 圖中的黑色座標值代表藍點在影像中的座標,紅色座標值分別代表藍點在 xir和 xvis的座標,可以發現紅色座標值是相同的。因為座標軸 xir和 xvis是用兩邊影像 各自的目標物建立的,所以兩邊影像中目標物的藍點座標雖然不一樣,但在座標 軸 xir和 xvis中要是相等的。原因是由於兩邊影像中的目標物就算是因攝影機的原 故,造成位置、旋轉、大小等的差異,以目標物的質心位置為座標原點仍可以消 去影像中位置差異的問題,而 PCA 算出來的特徵向量是代表目標物的分布方向, 特徵值則是代表目標物在影像中所包含的範圍,所以兩邊影像中的藍點座標在座 標軸 xir和 xvis中是相等的。 假設目標物在兩邊影像中的大小相同時(特徵值相等時),若要把紅外線影像 的點利用座標軸轉換成可見光座標軸的點,我們首先頇計算 xorig座標系至 xir座 標系的轉換關係與 xvis座標系至 xorig座標系的轉換關係。把目標物的每個像素由 原來紅外線影像上的座標軸 xorig轉換成 xir下的座標,並把此座標點直接當作是 xvis下的座標,再用座標轉換轉成可見光影像的 xorig座標,就可以讓紅外線影像 中的點轉換到可見光影像下的座標。 但因為兩台攝影機的焦距不同,造成物體在畫面中的大小不相同,所以必頇 在座標軸 xvis轉換成 xorig前,用目標物在紅外線和可見光影像的特徵值比值做縮 放。假設目標物的特徵值分別為λxvis, λyvis, λxir, λyir,若把影像從紅外線轉換到可 見光座標,目標物進行縮放時就必頇把 x 座標乘上 Scalex=λxvis /λxir,y 座標乘上

響。 (a) (b) 圖 3-13. 由目標物計算出 PCA 的座標示意圖,綠色座標為 xorig (a)紅色座標的 X 軸為 xir (b)紅色座標的 X 軸為 xvis。 圖 3-14. 座標轉換的例子。 3.5 影像對位結果顯示方法 在顯示紅外線的目標物轉換到可見光影像中的方法上,若是把整個目標物 (圖 3-15(a)中的目標物)轉換到可見光影像中,會把可見光影像中的目標物整個覆 蓋住,圖 3-15(b)為轉換後的結果,可以發現目標物被稍微拉長了一點,但因為 可見光的目標物被蓋住,這樣就不容易判斷轉換後的結果是否精確。所以我們對 紅外線影像的目標物的輪廓做轉換,若是把輪廓轉換到可見光影像中,就不會把 可見光的目標物覆蓋住,也就容易判斷轉換的結果是否精確。

找尋紅外線目標物輪廓的方法,我們使用文獻[10]所提出的簡化 Sobel 對目 標物做處理,利用 Sobel filter 對前景、背景分割的結果圖做處理可以迅速地找出 目標物的輪廓(如圖 3-16)。把紅外線目標物的輪廓轉換到可見光影像中的結果如 圖 3-17,可以發現輪廓與可見光影像中的目標物不太合,但另一個影像的結果(圖 3-18)卻沒有這個誤差,我們發現這是因為攝影機的焦距不同造成轉換矩陣產生 誤差。我們將在 3.7 節介紹誤差調整,讓轉換的結果更加精確。 (a) (b) 圖 3-15. (a)為中紅外線影像,(b)為中紅外線影像的目標物轉換到可見光影像的結果。 (a) (b) 圖 3-16. 以前景、背景分割圖找目標物輪廓,(a)中紅外線影像的輪廓,(b)可見光影像的輪廓。

圖 3-17. 中紅外線影像的輪廓轉換到可見光影像的結果。 (a) (b) 圖 3-18. 另一組影像的轉換結果,(a)中紅外線影像的輪廓, (b) 中紅外線影像的輪廓轉換到可見光影像的結果。 3.6 誤差調整 由上一小節可以發現,影像對位的結果會有一些誤差,這是因為兩攝影機所 拍攝到的人體區域不完全相同,所以我們需要把座標轉換的矩陣進行調整,讓結 果較能讓人接受。除了轉換結果會有誤差外,有時可見光的目標物會因為前景物 與背景相似,使得前景物分割成兩塊以上,若是只取數個分裂前景物的最大的一 塊求出座標轉換矩陣,則此轉換結果會與預期的結果有很大的誤差,我們將在下 面小節介紹這些問題的解決方法。

3.6.1 調整座標轉換矩陣

因紅外線攝影機和可見光攝影機的焦距不同,所以當攝影機沒有目標物完整 的區域時(例如:只有人的上半身),所拍攝到的目標誤比例會有所不同。例如圖 3-4(a)(c),可以從人物褲子的口袋發現,有些可見光影像有的部分紅外線影像可 能沒有。這種情況下若單純做座標轉換會有比例上的誤差(如圖 3-17),因此我們 使用類似 three step search 的方法,將目標物的特徵值比值當做可調整的參數, 尋找轉換後的目標物和原本影像中的目標物的分布面積交集和聯集,並計算交集 和聯集的比值,找出比值最大的參數當作是較佳的轉換參數。

以紅外線影像轉換到可見光影像座標為例子,對做座標轉換時的特徵值比值 進行微調時有以下四個步驟。

(a) 以 3.4 節中的 Scalex和 Scaley計算 Scalex´=Scalex±r,Scaley´=Scaley±r (r=0.1 或 0),這九種情況下的轉換結果。

(b) 假設目標物在紅外線影像轉換後的分布為 T,而目標物在可見光影像的 分布為 P,利用式 3.6 計算 T 和 P 的重疊比率(Ratio )。

(c) 找出這九種情況下比值最大的參數(Scalex´與 Scaley´)讓 Scalex=Scalex´,

Scaley=Scaley´。 (d) 令 r=r/2 後再回到(a),直到做了三次以後就跳出。 P T P T Ratio (3.6) 而做了調整後的結果如圖 3-19(b)所示,結果比調整前(圖 3-19(a))確實較能代表目 標物的輪廓。

(a) (b) 圖 3-19. (a)為做調整前的轉換結果,(b)為調整後的轉換結果。 3.6.2 偵測分裂的目標物 有時前景、背景的分割結果不是很理想(如圖 3-20(b)有兩個前景區塊),可利 用之前偵測到的目標物分部區域找出所有前景區塊中為目標物的部分,也就是計 算影像中前景區塊(圖 3-20(b))與前一張影像目標物區塊(圖 3-20(a))的交集。交集 的區域如圖 3-21 所示,若是前景區塊有 70%跟之前目標物區塊有交集,則判斷 此前景區塊為目標物的一部分。使用此方法前我們的結果為圖 3-22(a),而用此 方法判斷出的結果如圖 3-22(b)所示,值得注意的是,這個方法必頇是前景物體 在連續兩張景像中移動量不大的情況才能使用。 由於可見光影像進行前景、背景分割時容易受到雜訊影響,造成目標物周圍 有許多雜點,如圖 3-23,目標物左側的雜點會因為與前一張影像的目標物區塊有 交集,所以也會被當成目標物的一部分。若是使用此目標物區塊計算座標轉換的 矩陣,則會有圖 3-24(a)的結果,可以發現轉換的結果十分不理想。我們發現這 種情況發生時,在式 3.6 的重疊比率(Ratio)值會突然降低,我們藉由設定一閥值

TRatio偵測 Ratiot與前一張影像的 Ratiot-1值差距是否過大,若差距過大則使用前 一張影像的座標轉換關係進行轉換,如圖 3-24(b)這樣就可避免因突然出現的雜 訊而造成轉換的狀況不理想。

(a) (b)

圖 3-20. (a)時間為 t-1 的目標物,(b)時間為 t 的前景區塊,目標物被切成兩半。

圖 3-21. 紅色區域為圖 3-20(a)(b)重疊的區域。

(a) (b)

圖 3-23. 前景、背景分割結果有許多雜點。 (a) (b) 圖 3-24. 因雜點影響的轉換結果,(a)將雜點當作目標物的座標轉換結果, (b)沿用前一張影像的座標轉換。 3.7 偵測辨識不清的目標物及資訊彌補 有時可見光影像的前景、背景分割結果不一定能正確分出前景和背景,由於 可見光影像無法清楚辨識目標物,但是紅外線影像卻可以清楚地看到(如圖 3-25)。 我們需要判斷影像中是否有完整目標物,我們以切割出的前景面積是否在一定大 小以上做為判斷的依據,若前景物面積太小(像是圖 3-25(b)的前景區塊)則我們判 斷物體資訊物不完整而不做轉換參數的運算。這時就可以用之前所儲存的轉換矩 陣把紅外線影像中目標物的輪廓做座標轉換,又因可見光影像以看不清楚目標物, 所以在畫面左上角顯示 “Target lost” 做為警示(如圖 3-26)。

(a) (b) (c) (d) 圖 3-25. 無法清楚辨識目標物的可見光影像與對應之中紅外線影像,(a)可見光影像,(b)可見光 影像無法正確地分割出前景物體,(c)紅外線影像,(d) 紅外線影像可正確地分割出前景 物體。 (a) (b) 圖 3-26. 系統發出警訊並做資訊彌補之結果圖,(a)為可見光影像,(b)沿用之前所儲存的轉換矩 陣所做的轉換結果,並在畫面的左上角顯示“Target lost”做為警示。

第四章 基於異質攝影機之目標物定位

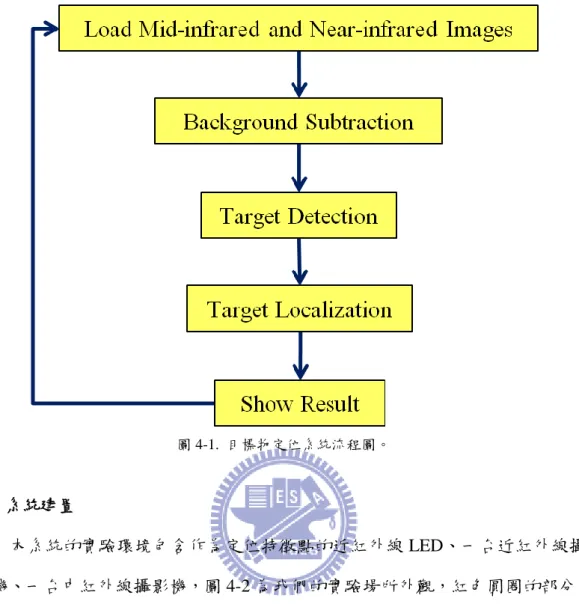

在夜間的監控環境中,因光源不足,經常使用紅外線攝影機來偵測是否有可 疑人物。近紅外線攝影機透過攝影機上附加的近紅外線燈泡發出近紅外光來拍攝 影像,若是人物太靠近攝影機就會產生過度曝光的現象,太遠則會因光源不足而 無法清楚顯示,能拍攝的距離就有所限制。而中紅外線攝影機可直接偵測物體本 身發出的紅外線波長(也就是溫度),但中紅外線攝影機價格昂貴,通常只架設在 重要的位置,若是為了增加拍攝範圍而使用動態攝影機,則會因背景不易建立, 使得偵測到人物時,不容易判斷攝影機拍攝的方向以及人物的位置。本研究將使 用一台近紅外線攝影機、一台中紅外線攝影機以及一些當作定位特徵點的近紅外 線 LED 來進行動態偵測,當發現人物時能夠判斷此人物所在的位置並回傳座標 資訊。由於需要架設做為定位特徵點的 LED,本研究的實驗環境較適合應用於 大樓或住家等室內的環境中,以便對攝影機的位置進行定位。圖 4-1 為目標物定 位的流程圖,首先取得攝影機的影像,並做前景、背景分割,之後利用前景物找 尋目標物,以目標物在影像中的位置進行座標定位,最後顯示目標物在空間中的 座標。圖 4-1. 目標物定位系統流程圖。 4.1 系統建置 本系統的實驗環境包含作為定位特徵點的近紅外線 LED、一台近紅外線攝 影機、一台中紅外線攝影機,圖 4-2 為我們的實驗場所外觀,紅色圓圈的部分為 我們架設的定位特徵點。另外我們會計算兩攝影機之間的座標轉換關係,因此我 們把兩攝影機放在同一平台上,讓攝影機能同時移動,才不會破壞座標轉換關係, 又因為需要用到影像中的時間資訊,故攝影機的移動速度不能太快,系統假定攝 影機的影像與前一張影像至少有 2/3 的畫面是拍攝環境中相同的區域。我們所使 用的近紅外線攝影機能拍攝的距離很短(約距攝影機 1~2 公尺的位置),於是我們 決定把攝影機上所附的近紅外線燈泡關閉,拍攝對象以定位特徵點為主,讓攝影 機無法拍攝到 LED 以外的物體。因為 LED 能自己發出近紅外光,而不是透過燈 泡發出的近紅外光來讓攝影機拍攝,所以就算距離攝影機超過 5 公尺依然能清楚 地被拍攝到。由於近紅外線攝影機被調整成無法拍攝環境中的人物,我們使用中 紅外線攝影機拍攝環境中的較高溫人物當作目標物,以進行定位,又因的定位特 徵點的架設位置很靠近地板,所以我們以拍攝地板上的物體或人物的足部來進行

定位(如圖 4-3)。 本系統在實際拍攝前需要先計算出兩攝影機影像間的座標轉換關係與給定 攝影機起始位置,圖 4-4 為場景配置圖,有標出攝影機與定位特徵點的位置,圖 中的格子相當於地板的格線,我們把攝影機擺放在環境中所設定的起始位置,並 同時拍攝一張起始影像(圖 4-5),利用影像中的資訊計算座標轉換關係。圖 4-5(a) 為中紅外線拍攝的起始影像,由於電源插座會發出高溫,為了簡化攝影機校正時 的步驟,我們用書本把它遮住。圖 4-5(b)為近紅外線所拍攝到的起始影像,圖中 的亮點是定位特徵點在影像中的位置,而中紅外線中較亮的區域是定位特徵點旁 的電阻因發熱而在影像中顯得較亮,電阻與燈泡的位置很接近(相距 1cm 以內), 所以我們把中紅外線影像中的電阻當作是定位特徵點的位置。圖 4-5(c)為攝影機 在起始位置並開燈拍攝的影像,可以看到蓋住插座的書本。起始影像中必頇有四 個以上 LED,我們使用投影幾何轉換(homography)的方法,找出兩攝影機影像間 的座標轉換關係。 圖 4-2. 實驗環境外觀。

(a) (b) 圖 4-3. (a)拍攝地面上的發熱物體,(b)拍攝人的足部。

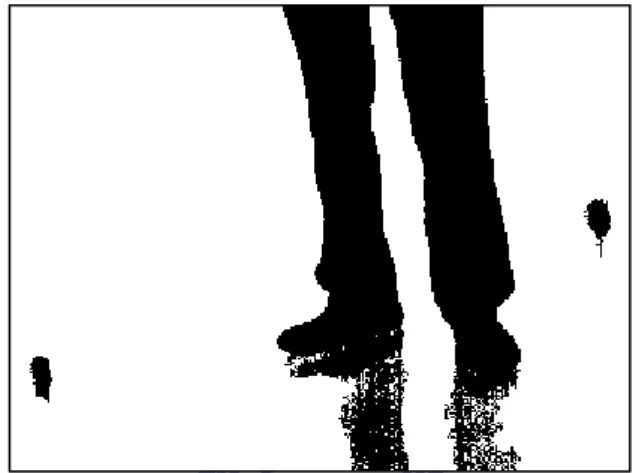

(a) (b) (c) 圖 4-5. (a)為中紅外線的起始影像,(b)為近紅外線的起始影像, (c)為(b)影像場景開燈後的可見光影像。 4.2 取得目標物位置 取得攝影機所拍攝的影像後,由於近紅外線只拍攝定位特徵點所發出的亮光, 中紅外線影像我們以高溫物體當作感興趣的對象,所以系統設定一個閥值來進行 前景、背景分割,並對切割出的前景使用連通物件法找出影像中的目標物區塊。 由於人所穿的鞋子以及褲子下擺與衣服不同,溫度較低,容易把鞋子和褲子的一 部分當成背景(如圖 4-6),若是把閥值降低,又容易使背景區域誤判成前景(如圖 4-7)。我們將在 4.2.1 節提出改良[11]所提出的溫度等高線圖演算法,把每個目標 物周圍與目標物溫度接近的像素也當成目標物的一部分。在 4.2.2 節介紹得到較 完整的目標物後,計算出目標物在影像中具代表的位置,進而執行後續目標物之 定位。

(a) (b)

圖 4-6. (a)為拍攝人的中紅外線影像,(b)為用閥值進行前景、背景分割的結果。

圖 4-7. 以較低的閥值進行前景、背景分割的結果。

4.2.1 以溫度等高線圖演算法得到完整目標物

此演算法是利用一個區塊其溫度平均值 Avei,尋找溫度介於 Avei和 Avei - Tsim 的像素,形成新的區塊,其中 i 代表區塊的編號,Tsim為相差一定數值內為相近 溫度的閥值。為了避免區塊無限制地成長,我們以低於臨界值 TThr的溫度當作是 環境溫度,低於環境溫度的像素必定為背景像素,然而針對單一環境所最佳化後 的 TThr,無法適用於其他環境。所以我們計算影像中的背景區域的平均值當成是 環境溫度,如此一來就算環境溫度有所變化,也能將 TThr做最佳化。 溫度等高線圖演算法的步驟: (a) 將影像以 5 × 5 mask 計算每個像素的區塊平均值後,將每個目標物的初始溫 度平均值 Avei設定為整個目標物區塊的平均值。

(b) 將目標物周圍被當成背景的部分,且溫度和平均值與 Avei的差異小於臨界值 Tsim2的像素找出來,當成此目標物區塊中的一部分。 (c) 用新加入的點更新 Avei的值。 (d) 重複步驟(b)和(c),直到步驟(b)中沒有找到任何點,或是(c)中 Avei的值小於 臨界值 TThr。 在步驟(a)中,計算計算每個像素的區塊平均值是因為不想因雜訊的干擾, 造成像素在判斷是否為目標物時的錯誤。而找出溫度介於 Avei和 Avei - Tsim的像 素當成目標物,是因為我們希望每次找出的像素與目標物的溫度相近,且影像中 前景物與背景因有一段溫度差,若是溫度差大於 Tsim,我們就判斷這是前景與背 景的交界點。使用溫度等高線圖演算法後,我們會有圖 4-8 的結果,可以發現鞋 子的部分有比較完整的找出來。 圖 4-8. 以溫度等高線圖演算法找出的前景。 4.2.2 取得目標物在影像中與地板的交界點 得到目標物區塊在影像中的資訊後,由於近紅外線影像的目標物不大(約 10 個像素),我們取目標物的質心位置當作是定位特徵點在影像上的座標。而中紅 外線影像中的目標物並非整個都在地板上,我們取一些站立點來代表目標物與地 板交界的點,並利用座標轉換,把站立點的座標轉換到近紅外線影像中,再用同 樣是在地板上的定位特徵點做定位。經由觀察可以發現,如圖 4-9 目標物在影像 中最下方的點通常會和地板接觸,但只使用最下方的點有時會發生站立點消失的

情況,如圖 4-10,當原本圖 4-9 分開的雙腳連一起時,站立點會由兩個變成一個, 於是我們使用區域最低點演算法找出目標物的站立點,用來代表目標物區塊中, 與地板接觸的點。 區域最低點的演算法,首先要取得目標物的輪廓,並依照輪廓上的點依照順 序定為 Pi,其中 i 為輪廓點的編號,P0為影像中最上方的輪廓點。從 P0開始取 連續兩個點 Pt和 Pt+1,用式 4.1 累積 Ht的值,並當式 4.2 成立時便判斷點 Pt為區 域最低點。 otherwise H y P y P if H y P y P H t t t t t t t 0 0 ) ( ) ( ) ( ) ( 1 1 1 1 (4.1) H t t t y P y andH T P( ) 1( )0 (4.2) 其中 Ht代表影像中目標物的輪廓連續下降的高度,當高度往上提升的地方,點 Pt必定是這個區域最低的點,TH代表一個閥值,當下降的高度大於 TH時,我們 認定此點為區域最低點。圖 4-11 為使用區域最低點演算法所找到的目標物站立 點,可以看出一個目標物可能會有兩個以上的站立點。 (a) (b) 圖 4-9. 兩個紅圓圈為目標物的站立點位置,(a)中紅外線影像,(b)二質化影像。

(a) (b) 圖 4-10. 紅圓圈為目標物的站立點位置,(a)中紅外線影像,(b)二質化影像。 圖 4-11 用區域最低點演算法所找到的站立點。 4.3 目標物定位 經由上述步驟取得目標物的站立點後,我們把中紅外線影像的目標物站立點 利用兩攝影機影像間的座標轉換關係把站立點座標轉換到近紅外線影像中,而我 們將使用這些站立點的資訊進行目標物定位。我們提出兩種方法來進行目標物定 位,分別是以環境空間座標系為中心之平面轉換定位方法以及以攝影機座標系為 中心之平面轉換定位方法。這兩種方法主要差別在於,前項方法是利用 homography,把影像中的目標物站立點轉換到環境空間座標的定位;而後者的方 法是利用 homography,把影像中的目標物站立點轉換到以攝影機為中心的空間 座標,根據此座標中目標物站立點與定位特徵點的相對位置進行定位,我們將在 4.3.1 節與 4.3.2 節分別詳述。

4.3.1 以環境空間座標系為中心之平面轉換定位方法

此方法是引用[12]的方法,利用 homography 概念在影像平面(image plane)與 環境空間平面(world plane)之間建立平面投影轉換關係,利用此轉換關係可以求 出目標物站立點在環境空間座標的位置。解析投影幾何轉換矩陣(H)的方式有三 種:(1)非線性幾何解(non-linear geometric solution),(2)非齊次線性解

(non-homogeneous linear solution),(3)齊次線性解(homogeneous solut6ion)。根據 [12],我們使用第三種方法以 SVD(singular value decomposition)求出 H,此方法 的優點在於,當有多個點的部分座標值為 0 時,仍然可以產生最小平方差的結 果。 由場景配置圖(圖 4-4)可以知道定位特徵點的環境空間座標,我們可以利用 此座標與近紅外線影像中定位特徵點的影像座標求出 H,用 H 就可以直接把影 像上的站立點位置直接轉換到環境空間座標,如圖 4-12(a)為中紅外線利用區域 最低點演算法找到的站立點,而站立點轉換到環境空間後之位置如圖 4-12(b)所 示。 (a) (b) 圖 4-12. (a)紅點為中紅外線影像的站立點,(b) 站立點轉換到環境空間座標的位置。 4.3.2 以攝影機座標系為中心之平面轉換定位方法 當攝影機移動時,不一定會有四個以上的定位特徵點顯示在影像上(如圖 4-13),或是有三個以上定位特徵點座標共線時(如圖 4-14),這時就無法使用上一

小節所介紹的方法求出 H 來計算目標物站立點的環境空間座標。本節介紹的方 法,當影像中的定位特徵點座標有兩個點以上時,便能進行定位。首先在 4.1 節 系統建置時,利用起始影像與攝影機在環境空間座標的位置求出 homogarhpy 矩 陣 Hcam,可將影像平面轉換到以攝影機為座標系中心的平面。由於我們使用的是 攝影機在環境空間的座標,所以此座標系與環境空間座標系只有旋轉與平移的關 係。我們將影像中的目標物站立點與定位特徵點在影像中的座標用 Hcam轉換到 攝影機座標系,如圖 4-15,紅色的點為定位特徵點的位置,綠色的點為目標物站 立點,我們已知 V1、V2、V1´,只要求出 V2´就能用定位特徵點在環境空間的座標 加上 V2´向量,求出目標物站立點在環境空間的座標。 我們已知 V1、V2與 V1´、V2´為不同座標系下的相同向量,只要我們找到 V1 轉換到 V2的轉換矩陣 M(包含旋轉、縮放),就可用 V1´求出 V2´。首先計算 V1、 V2之間的夾角θ,利用式 4.3 可以計算出 cosθ 與 sinθ 的值。由於向量的起點相同, 所以兩向量沒有平移,再用式 4.4 求出向量縮放的比例 R,就可以求得轉換矩陣 M(式 4.5)。 sin | || | cos | || | 2 1 2 1 2 1 2 1 V V V V V V V V (4.3) | | | | 1 2 V V R (4.4) cos sin sin cos R R R R M (4.5) 使用 M 將 V1´轉換成 V2´,再利用定位特徵點在環境空間座標的位置,就可以求 出目標物站立點在環境空間的座標,圖 4-16 顯示轉換後的位置。

圖 4-13. 有一個定位特徵點被目標物遮蔽。 圖 4-14. 有三個定位特徵點共線。 (a) (b) 圖 4-15 . (a)環境空間座標系,(b) 攝影機座標系。 (a) (b) 圖 4-16. (a)影像中有三個定位特徵點共線,(b)利用兩個定位特徵點進行目標物定位的結果。

4.4 判斷影像中的定位特徵點位置 由於拍攝影像上的定位特徵點位置會隨著攝影機移動而改變,因此我們必頇 先判斷影像中的定位特徵點在環境空間座標中的位置,才能進行定位。在系統建 置時,我們已知定位特徵點座標,當實際開始拍攝後由於攝影機移動的速度不是 很快,可以判斷畫面中最左(右)邊的定位特徵點與前一張影像最左(右)邊的定位 特徵點是同一個定位特徵點或是鄰近的定位特徵點。 我們把定位特徵點的位置進行編號(如圖 4-17),起始影像的定位特徵點為編 號 4~7,當取得新進影像後,最左邊的定位特徵點編號必定是 3~5 其中一個,最 右邊的定位特徵點在 6~8 之中。我們利用前一張影格的定位特徵點位置判斷目前 影格的定位特徵點位置,以圖 4-18 為例,圖 4-18(a)(b)分別為連續兩張影像,我 們計算圖 4-18(a)(b)間定位特徵點之間的距離,當距離小於一設定的閥值(本系統 設定為 5 像素),則判斷兩定位特徵點是一組對應。若定位特徵點找不到對應, 且此定位特徵點接近畫面邊緣(本系統設定距離影像邊界 5 像素即為畫面邊緣), 則判斷為定位特徵點離開畫面,或是拍攝到新進的定位特徵點。圖 4-18(a)中編 號 P1~P3分別與圖 4-18(b)中的 P2´~P4´對應,P4與 P1´沒有對應的定位特徵點,由 於兩者都在畫面邊緣,且 P4為前一張影格的定位特徵點,所以我們判斷 P4離開 畫面,而 P1´為目前影格新出現的定位特徵點,所以我們判斷 P1´為新的定位特徵 點。當我們發現有新的定位特徵點後,我們找出影像中與新進特徵點最近的特徵 點,圖 4-18(b)中與 P1´最接近的定物特徵點是 P2´,且我們知道 P1´在 P2´的左邊, 若 P2´的定位特徵點編號是 4,我們就可推算 P1´的編號是 3,同樣地我們也可以 用這個方法判斷出現在 P2´右邊的新定位特徵點。 當特徵點沒有對應且不是在畫面邊緣時,我們判斷此特徵點被目標物所遮蔽, 如圖 4-19,目標物遮住了 P3。我們一樣找出連續影像的定位特徵點對應,接著 我們會發現 P3找不到對應的定位特徵點,且 P3不在畫面邊緣,這時我們計算其 他定位特徵點在連續影像中的移動向量,以平均向量估測被遮住的定位特徵點位 置,當取得下一張影像時,此預測位置也會被當成一個定位特徵點。

由於計算以攝影機為中心座標之平面轉換定位方法時會參考到攝影機的位 置,因此在計算出定位特徵點的位置後,需更新目前影像的攝影機位置,讓系統 在定位目標物時使用。首先在系統建置時,我們可以計算影像平面與環境空間平 面的轉換關係,把已知攝影機在環境空間的座標轉換到影像平面上,由於攝影機 在影像上是一個虛擬的位置(如圖 4-20),箭頭為攝影機的視角。當攝影機移動時, 我們可以把此虛擬位置用目標物定位的方法轉換到環境空間座標。 圖 4-17. 我們把場景配置圖的定位特徵點進行編號。

(a) (b)

圖 4-18. 各新增以及消失有一個定位特徵點的情況,(a)影格 t-1,(b)影格 t。

(a) (b)

圖 4-19. 其中一個定位特徵點被遮蔽的情況,(a)影格 t-1,(b)影格 t。

4.5 結果顯示方法 計算出目標物站立點在環境空間的座標後,我們以一個空心圓來代表站立點 的位置,但是只顯示這些資訊在畫面上在安全監控的方便性上有點不足。我們決 定把攝影機的位置、朝向、監控範圍以及攝影機所拍攝到的定位特徵點也都提供 在顯示地圖上,讓使用者能快速了解監控環境的狀況,也方便確認哪些區域是監 控的死角。 攝影機的監控範圍也就是影像的四個角落所圍成的區域,攝影機的朝向為攝 影機朝畫面中心連線之方向,我們同樣的把這四個角點與畫面中心的座標轉換到 環境空間座標,就可以得到攝影機在環境空間中的監控範圍與朝向。由於攝影機 並不是直接放在地板上,而是架設在地板上方約 100cm 的地方,所以顯示攝影 機朝向的結果會與實際情況有些微的誤差。圖 4-21 為用此顯示方法顯示的結果, 其中紅框是攝影機的監控範圍,藍色的射線是攝影機的位置與朝向,紅色的*是 影像中有拍攝到的定位特徵點。 (a) (b) 圖 4-21. 顯示較多資訊的結果圖。

第五章 實驗結果

本章內容將依照前兩章所提到的影像資訊融合方法,利用程式進行實驗並分 析。本系統使用的程式語言為 C#,用 Microsoft Visual Studio 2005 上開發,測詴 電腦的環境為 Pentium 4 3.4G,4G RAM,作業系統為 WindowsXP。我們分析第 三章所呈現的結果中,轉換後的中紅外線輪廓所包含的區域與可見光影像的目標 物區塊的相似程度。之後呈現第四章的系統,當目標物或攝影機移動時所定位出 的座標之結果。 5.1 前景影像對位的結果探討 第三章我們希望利用中紅外線影像來彌補當目標物在可見光影像中無法清 楚辨識的情況,以下圖 5-1~5-5 分別是一組影像的第 155、250、355、356、450 影格,圖 5-6 為由中紅外線目標物轉換至可見光影像後,與可見光影像目標物的 面積用式 3.6 計算重疊比率的結果。可以由圖 5-1 發現當目標物剛出現在畫面中 時,由於目標物區塊並不完整,若是進行座標轉換會造成影像對位的結果非常的 差,所以我們在目標物完整出現在畫面中才進行座標換。圖 5-2 為目標物完整出 現在影像中的座標轉換結果,圖 5-3 是目標物判斷為辨識不清之前的轉換結果, 由於受到雜訊影響,轉換的結果不是很理想。圖 5-4 與圖 5-5 分別是目標物剛判 斷為辨識不清與判斷為辨識不清後一陣子的轉換結果,皆由之前儲存的座標轉換 關係進行轉換。圖 5-6 中可以發現有時重疊比率會突然降低,這是因為可見光影 像中的雜訊過多,造成判斷可見光目標物時發生錯誤,我們使用 3.6.2 節的方法 偵測是否有這種情況發生,若有則使用前一張影像的座標轉換關係。另外圖 5-7~5-9 為另一組影像所做的轉換結果,可以由圖 5-7 與圖 5-8 發現環境中的光 源有一些變化,由於目標物在可見光中都是清晰可明顯分辨的,所以前景、背景 分割的結果還不錯,只有一些影像的重疊比率會突然降低。圖 5-10 為式 3.6 重

疊比率的結果,重疊比率都在 0.8 以上,都是十分理想的轉換結果。 圖 5-11(b)為第一組影像第 319 影格時前景、背景的分割結果,出現很多區 塊較大的雜點並與目標物連在一起,由 3.6.2 節偵測分裂目標物的方法,我們會 把目標物左側的雜點也當作是目標物的一部分,但由於,也就無法計算出較好的 轉換結果(圖 5-11(a))。 (a) (b) 圖 5-1. 目標物剛出現在畫面中時因不完整所以不做轉換,第 155 影格, (a)紅外線影像,(b)可見光影像。 (a) (b) 圖 5-2. 目標物完整出現在影像中時的轉換結果,第 250 影格,(a)紅外線影像,(b)可見光影像。

(a) (b) 圖 5-3. 即將判斷目標物消失前的轉換結果,第 355 影格,(a)紅外線影像,(b)可見光影像。 (a) (b) 圖 5-4. 判斷目標物消失瞬間的轉換結果,第 356 影格,(a)紅外線影像,(b)可見光影像。 (a) (b) 圖 5-5. 判斷目標物消失一陣子後的轉換結果,第 450 影格,(a)紅外線影像,(b)可見光影像。

圖 5-6. 中紅外線影像目標物轉換至可見光後的重疊比率。

圖 5-7. 第 181 影格的轉換結果。 圖 5-8. 第 241 影格的轉換結果。

圖 5-10. 另一組影像的中紅外線影像目標物轉換至可見光後的重疊比率。 (a) (b) 圖 5-11. 影像對位因雜訊造成的誤差,(a)可見光影像,(b)可見光影像的前景。 5.2 目標物定位的結果探討 我們利用近紅外線與中紅外線影像,在夜間進行目標物與攝影機的定位。由 於攝影機的定位只需要利用近紅外線影像即可達到,我們先在 5.2.1 節探討如何 減少因影像的雜訊造成定位誤差的方法,之後在 5.2.2 節我們分析系統對目標物 定位的穩定度。

5.2.1 減少定位誤差的方法 系統運作時,我們發現在攝影機沒有移動時,目標物或是攝影機的位置仍發 生跳動,原因是受到影像中的雜訊干擾造成判斷目標物和定位特徵點位置時會有 誤差。我們提出三個方法來計算定位特徵點的位置,分別是(1)區塊質心,(2)區 塊的外接矩形(bounding box)中心,(3)區塊平均亮度中最亮的點。我們分別以這 三種方法計算 LED 在影像中的位置,並計算攝影機在環境空間的座標。 以區塊質心作為定位特徵點位置 此方法為計算定位特徵點在近紅外線影像中,以前景區塊的質心位置當作是 定位特徵點的座標。我們把攝影機定位的點以 x, y 的值為縱軸、時間為橫軸畫在 座標上,圖 5-12 為定位的結果,可以發現定位的結果很不穩定。 圖 5-12. 以區塊質心作為定位特徵點位置的定位結果。 以區塊的外接矩形中心作為定位特徵點位置 為了穩定定位的結果,我們詴著使用前景區塊的外接矩形中心作為定位特徵 點的座標。圖 5-13 為定位的結果,我們發現當攝影機位置跳動時會非常的劇烈。

圖 5-13. 以區塊的外接矩形中心作為定位特徵點位置的定位結果。 以區塊平均亮度中最亮的 n 個點作為定位特徵點位置 由於定位的誤差是由於影像上的雜訊所造成的影響,我們計算前景區塊的像 素與周圍像素的平均值,找出平均值最大的 n 個點,也就是最亮的 n 個點座標進 行平均當作是定位特徵點的座標,本實驗我們令 n = 3。圖 5-14 為定位的結果, 我們發現定位的結果比使用區塊質心的方法穩定,但是還是有跳動的情況。 圖 5-14. 以區塊平均亮度中最亮的 3 個點作為定位特徵點位置的定位結果。

加入時間資訊減少誤差 我們參考[13]的方法加入時間軸上其他定位特徵點位置的資訊,以減少定位 時的誤差。根據[13],平均定位後的座標點會有斷層的現象,也就是平均時間軸 上定位出的環境空間座標對減少誤差的效果並不顯著,因此我們採取平均從影像 中取得的定位特徵點位置。當新進影像取得的定位特徵點編號與前一張影像相同 時,我們以式 5.1 更新定位特徵點的位置,若是取得的編號與前一張不同,則直 接使用新進影像的定位特徵點位置進行定位。 t i t i t i P P P

1 (1

) (5.1) 其中 P 為定位特徵點在影像上的座標,i 為定位特徵點編號,t 指目前影像的編 號,

是更新速率,系統設定

值為 0.33。我們利用此方法來減少以區塊質心 作為定位特徵點位置做定位的誤差,結果如圖 5-15,可以發現與圖 5-12 相較之 下較為穩定。同樣地我們利用此方法來減少以區塊平均亮度中最亮的 3 個點作為 定位特徵點位置定位的誤差,結果如圖 5-16,此結果也比圖 5-14 要再穩定一些。 因此系統最終是採用以區塊平均亮度中最亮的點作為定位特徵點位置定位加上 加入時間資訊減少誤差的方法,來減少因雜訊干擾而造成定位的誤差。 圖 5-15. 加入時間資訊,以區塊質心作為定位特徵點位置的定位結果。圖 5-16. 加入時間資訊,以區塊平均亮度中最亮的 n 個點作為定位特徵點位置的定位結果。 5.2.2 目標物定位的結果分析 我們在地板上放了一個固定位置的發熱物體(圖 5-17),其座標為(68, 53),我 們先讓攝影機靜止不動對物體拍攝,目標物的定位結果如圖 5-18 所示,而圖 5-19 為定位系統所顯示的結果圖,我們發現定位出的座標與擺放的位置有些許差異, 這是因為在中紅外線影像中,目標物所發出的紅外線波長會因為地板反射,使得 目標物附近的地板被偵測為高溫,前景、背景的分割結果會把這部分包含進去, 再利用區域最低點演算法就會找到影像座標中比預先要低一點的站立點(如圖 5-20)。 另外我們把攝影機進行轉動,我們先把兩台攝影機一起往右轉,停一下之後 再轉回原來的朝向。定位出的結果如圖 5-21,會發現有一個波峰和波谷向,這是 由於兩邊攝影機從拍攝到顯示在畫面上的時間有差距(約 6 個 frame),如圖 5-22 與圖 5-23 當中紅外線攝影機移動時近紅外線影像幾乎沒有改變,所以當攝影機 轉動時,目標物的定位會出現問題,而當停止轉動後,目標物的定位座標就與原 先的相同。雖然攝影機移動時會無法對目標物做定位,但一般的安全監控系統是 讓攝影機移動到一個定點進行拍攝後,再移動到另一個定點,因此移動時無法對 目標物定位的問題對安全監控系統並沒有影響。

圖 5-17. 擺放在地上的發熱物體。

圖 5-18. 攝影機不動時的目標物定位結果。

圖 5-20. 紅點為目標物的站立點。

第六章 結論

6.1 結論 將影像處理、圖形辨識的概念應用於安全監控的研究探討越來越多了,包括 人物辨識、遺失物偵測、入侵偵測等。有別於其他一般的視覺環境,本論文的目 的在於探討不同性質的影像,以各自影像中的資訊彌補另一邊影像資訊不足的部 分。 在影像對位的實驗結果方面,我們提供了一個當其中一台攝影機無法清楚辨 識影像中的目標時,可利用其他攝影機來輔助的方法。本論文的實驗中,可見光 影像與中紅外線影像中的資訊除了前景物輪廓都是人型之外,沒有太大的相關性。 所以當可見光影像的前景偵測不準確,造成目標物十分破碎時,容易讓座標轉換 的結果出現較大的誤差。因為轉換後的誤差調整是以面積的交集與聯集做判斷, 當目標物有破碎的區塊時,容易造成誤判。未來若是能有穩定的前景、背景分割, 結果也就會更好更穩定。 座標定位方面,我們使用了與[12]相同的場景與部分設備,並改進了[12]的 方法。除了能對攝影機的位置進行定位之外,我們利用中紅外線攝影機偵測環境 中高溫的物體,並對其進行定位。我們把定位的結果顯示在地圖上,也就是當有 多個監控區域的地圖時,我們可以把每個地圖合併在一起,把所有定位的結果顯 示在一個整合的地圖上,以便於讓保全人員進行監控,能迅速確實地了解可疑人 物的位置。由於被用來進行定位的定位特徵點有可能會被場景中的物體遮蔽,這 也是容易讓系統出現暫時無法進行定位的情況。 6.2 未來展望 本論文的特色在於融合不同性質影像的資訊,我們的系統分別可在日間以及 夜間使用。而我們在日間時使用的影像對位方法需要改善的地方是:可見光影像的前景、背景分割不是分得很好,若能有更適合的分割方法,影像對位的結果會 更好。夜間時使用的座標定位需要改善的是:攝影機移動時因影像不同步,造成 移動時無法進行準確的定位。

References

[1] D. G. Lowe, “Object Recognition from Local Scale-invariant Features,” IEEE

International Conference on the Proceedings of the Seventh, vol. 2, pp.

1150-1157, 1999.

[2] M. Awrangjeb and G. Lu, “A Robust Corner Matching Technique,” IEEE

International Conference on Multimedia and Expo, pp. 1483-1486, July 2007.

[3] F. Candocia and M. Adjouadi, “A Similarity Measure for Stereo Feature Matching,” IEEE Transactions on Image Processing, vol. 6, issue 10, pp. 1460-1464, 1997.

[4] S. D. Sharghi and F. A. Kamangar, “Geometric Feature-based Matching in Stereo Images,” Information, Decision and Control Conference, Adelaide, Australia, pp. 65-70, 1999.

[5] Z. Hamrouni, “Hierarchical Feature Grouping for Stereo Matching,”

Proceedings of the IEEE Southwest Symposium on Image Analysis and Interpretation, San Antonio, USA, pp. 160-165, April 1996.

[6] P. Fieguth, P. Bloore, and A. Domsa, “Phase-based Methods for Fourier Shape Matching,” IEEE International Conference on Acoustics, Speech, and Signal

Processing, vol. 3, pp. 425-428, 2004.

[7] O. Demuynck and J. L. Lafzaro, “An Efficient Approach Technique for Dynamical Infrared Visible Images Fusion,” IEEE International Symposium on

Intelligent Signal Processing, pp. 1-6, 2007.

[8] C. Stauffer and W. E. L Grimson, “Adaptive Background Mixture Models for Real-time Tracking,” IEEE Conference on Computer Vision and Pattern

Recognition, Fort Collins, USA, vol. 2, pp. 246-252, 1999.

Press, 2003.

[10] R. C. Gonzalez and R. E. Woods, Digital Image Processing, Addison-Wesley Publishing Company, pp. 577-581, 2002.

[11] Y.-H. Chen, “Visual Surveillance Using Infrared Images,” Master Thesis, National Chiao Tung University, June 2004.

[12] K.-C. Chen, “Vision-based Mobile Robot Localization Using Homographies,” Master Thesis, National Chiao Tung University, June 2007.

[13] Y.-T. Tsai, “Error Analysis of A Real-time Vision-based Pointing System,” Master Thesis, National Chiao Tung University, June 2007.

![圖 3-11. 元件連通物件法完成的結果。 圖 3-12. 圖 3-4(d)利用元件連通物件法得到的結果。 3.4 座標轉換 在得到目標物後,我們需要從目標物區塊中得到能代表目標物的資訊。目標 物的特徵除了面積、質心之外,我們使用文獻[9]所提出之 principal components analysis (PCA)分析目標物的特徵當作目標物的特徵之一,由目標物的特徵求出兩 邊影像間的轉換關係。 首先算出影像中目標物區塊的質心位置,假設目標物的質心座標為(X m ,Y m )。](https://thumb-ap.123doks.com/thumbv2/9libinfo/8392455.178765/23.892.265.634.114.321/標物資訊目標物的特徵除了面積目標物目標物之一由目標物目標物.webp)