Volume 22, No.2, 2017, pp. 105-115 DOI 10.6574/JPRS.2017.22(2).3

1國立成功大學測量及空間資訊學系 碩士生 收到日期:民國 105 年 12 月 23 日

2國立成功大學測量及空間資訊學系 教授 修改日期:民國 106 年 03 月 14 日

*通訊作者, E-mail: [email protected] 接受日期:民國 106 年 05 月 02 日

基於全景控制影像進行室內定位及導航之分析

黃聰哲

1*曾義星

2摘要

本研究旨在透過球形全景影像進行室內定位及導航分析,利用影像特徵匹配獲取連續影像重疊區共 軛像點的資訊結合控制點解算相機之位置。研究分二階段,第一階段為建立控制影像資料庫,控制影像 意指其外方位資訊已知,此部分可透過光束法區域平差完成,第二階段則是未知方位的球形全景影像(查 詢影像)透過自動化搜尋控制影像資料庫,獲取含有重疊區的控制影像資訊,藉由影像特徵萃取及匹配技 術求得共軛點資訊進而求解未知影像方位資訊。本研究使用兩種不同類型之共軛點進行室內定位實驗,

並根據實驗結果對位置及姿態進行分析及討論。

關鍵字:球形全景影像、室內定位及導航、影像匹配

1. 前言

全球衛星定位系統(Global Navigation Satellite System, GNSS)訊號因為訊號遮蔽問題無法應用於 室內定位,現今可透過影像匹配、無線網路(Wi-Fi) 輔助或是藍芽(bluetooth)等方式進行室內定位,其 中影像匹配相較於其他方式較為簡單、快速且方便。

過去的研究中相關理論以及方法不斷被提出,

Zhang et al.(2012) 提 出 透 過 全 向 相 機 (omni-directional 3D camera)作為機器人視覺導航 之用,全向相機結合一般相機與半圓面、拋物面或 是雙曲面之反射鏡獲取全景影像,由於全景影像可 以提供廣大視場角(FOV)而提升影像資訊量,因此 本研究主要使用球形全景影像(spherical panoramic image)進行定位定向分析討論,期望藉由球形全景 影像特性提升定位精度以及降低計算成本。然而由 於球形全景影像幾何關係較框幅式影像複雜,如何 確保影像匹配品質為本研究主要課題之一。核幾何 在過去研究中經被廣泛的應用,如影像共軛點偵測、

匹配或是影像間相對方位關係之建立,其相關理論 亦一再的被驗證,本研究亦使用核幾何建立球形全

景影像方位關係,在計算過程中會產生和傳統框幅 式影像不同之多重解問題,此一問題亦為本研究之 重點課題。基於前述問題,本研究有兩個主要目的,

第一為發展適用於球形全景影像匹配方法,期望能 夠提升球形全景影像自動匹配共軛點對正確性及 可靠性,第二為發展以核幾何方式進行球形全景影 像相對方位解算演算法。

2. 導航環境建置

2.1 基本概念

拍攝涵蓋室內區域球形全景影像,並計算所有 球形全景影像方位元素(POPs)完成控制影像資料 庫建置。當使用者拍攝新球形全景影像(查詢影像) 後,可以透過全景影像匹配及共軛點自動量測解算 使用者位置及方位並回傳位置資訊予使用者,圖 1 為本研究概念圖。為建立控制影像資料庫,在室內 環境須先設置若干控制點,藉由球形全景影像光束 法區域平差(Lin, 2014)求得所有影像之外方位元素。

透過無線傳輸技術,使用影像感測裝置拍攝影像後,

將影像傳送至伺服器並透過後端影像匹配及共軛

點自動化量測進行方位計算。

圖 1 導航環境設置示意圖

2.2 球形全景影像

球形全景影像包含完整的視場角(水平方向 360˚,垂直方向 180˚標記為 360×180),通常藉由單 台相機拍攝一系列重疊影像,或是同時透過多台相 機獲取影像拼接而成,舉例而言,Ladybug 5 即是 透過六個魚眼鏡頭同時獲取影像拼接為 360×150 之全景影像。本研究使用之全景影像即為 Ladybug 5 所攝,球形全景影像幾何關係較框幅式影像複雜,

影像座標系統採用球形座標系統,如圖 2 所示,其 中 R_SPI 為球形全景影像半徑,ρ則是由 z 軸起算 之天頂距,α則為由 x 軸起算之水平角,式(1)為物 空間點 P 定義於球形影像座標系統(I-Frame)。

圖 2 球形全景影像之影像座標系統

= =

sin cos sin sin

cos

... (1)

在利用球形全景影像進行影像匹配及共軛點 自動量測計算時,必須將球形影像投影至平面上,

考量到 Ladybug 5 影像解析度以及視場角對應關係,

單像元的角解析度為 0.045˚,影像解析度為 8000 × 4000,因此在水平方向上可達到 360˚視場角,在垂 直方向上可達到 180˚視場角。

2.3 球形全景影像外方位元素

假定有一理想球形全景影像,於影像上量測物 空間點 P 時,由攝影中心產生一射線至物空間點 P 及其像點 p。此二向量稱為物點向量及像點向量,

分別定義於物空間座標系統(O-Frame)以及球形座 標系統(I-Frame),攝影中心與物點、像點關係如圖 3 以及式(2)所示,其中 、 為 SPI 之外方位元 素(EOPs),而 可記為( , , ), 則是由三 個旋轉角(ω, φ, κ)所構成之旋轉矩陣。

圖 3 球形全景影像外方位示意圖

= + k ∙ ∙ ... (2)

2.4 球形全景影像光束法區域平 差

如同框幅式影像,球形全景影像物點、像點及 攝影中心仍維持共線之關係,量測重疊區影像連結 點座標以及地面控制點座標,透過球形全景影像光 束法區域平差(Lin, 2014)可以求得 SPI 外方位元素,

如圖 4 及式(3)和式(4)表示,其中 i 為 SPI 的順序,

j 為物點的順序,這些觀測方程式依最小二乘解算 出每個球形全景影像的外方位參數,以及至少兩張 球形全景影像觀測到的連結點坐標。

圖 4 球形全景影像光束法區域平差示意圖

+ = ... (3)

+ = ∙ ∙ ( − ) ... (4)

3. 球形全景影像相對方位

3.1 相對方位

相對方位描述兩張影像間之相對平移以及旋 轉之關係,但不包含兩張影像尺度因子。兩張影像 間的平移與旋轉關係皆含有三個參數,由於尺度不 確定性,因此影像之間的基線向量大小無法確定,

故相對方位獨立參數為五個。給予不同的尺度因子 可以得到不同的基線向量解,相對方位示意圖如圖 5 所示。

圖 5 球形全景影像相對方位示意圖

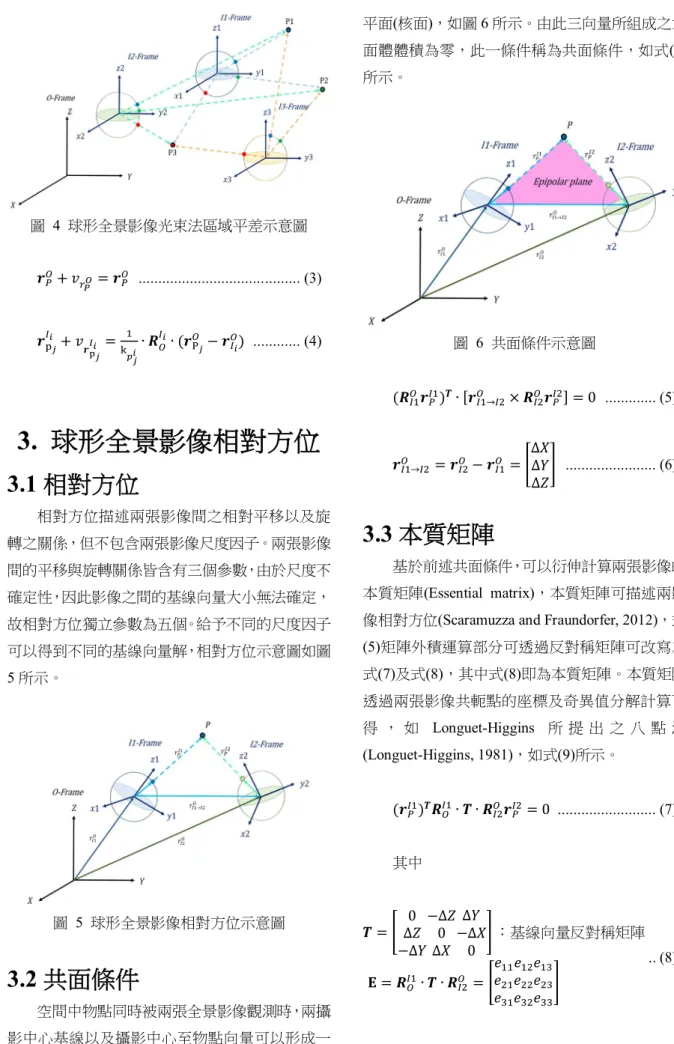

3.2 共面條件

空間中物點同時被兩張全景影像觀測時,兩攝 影中心基線以及攝影中心至物點向量可以形成一

平面(核面),如圖 6 所示。由此三向量所組成之六 面體體積為零,此一條件稱為共面條件,如式(5) 所示。

圖 6 共面條件示意圖

( ) ∙ [ → × ] = 0 ... (5)

→ = − =

∆

∆

∆

... (6)

3.3 本質矩陣

基於前述共面條件,可以衍伸計算兩張影像的 本質矩陣(Essential matrix),本質矩陣可描述兩影 像相對方位(Scaramuzza and Fraundorfer, 2012),式 (5)矩陣外積運算部分可透過反對稱矩陣可改寫為 式(7)及式(8),其中式(8)即為本質矩陣。本質矩陣 透過兩張影像共軛點的座標及奇異值分解計算可 得 , 如 Longuet-Higgins 所 提 出 之 八 點 法 (Longuet-Higgins, 1981),如式(9)所示。

( ) ∙ ∙ = 0 ... (7)

其中

= 0

∆

−∆

−∆

0

∆

∆

−∆

0

:基線向量反對稱矩陣

= ∙ ∙ = .. (8)

⋮

, , , , , , , ,

⋮

, , , , , , , , ~

⎣

⎢

⎢

⎢

⎢

⎢

⎢

⎢

⎡

⎦

⎥

⎥

⎥

⎥

⎥

⎥

⎥

⎤

= 0 ... (9)

為求解式(9) = 0,本文透過奇異質分解 (SVD)求解未知數 E,將 A 矩陣進行奇異質分解後 可以得到 = ,其中 V 矩陣中對應到最小 奇異值之行元素值即為本質矩陣之解。在框幅式影 像 中 , 本 質 矩 陣 可 以 購 過 內 方 位 和 基 礎 矩 陣 (Fundamental matrix)進行轉換,但是在球形全景影 像中則無法進行轉換。

3.4 估計相對方位

當解算得兩全景影像本質矩陣後,相對方位元 素可由矩陣拆解計算而得,假設其中一張全景影像 為基準點,不含任何旋轉量。由 Horn(1990)所提出 之演算法可得兩影像之間的平移向量以及旋轉矩 陣,如式(10)~式(12)所示,其中 = ( )且 為 第 i 行之元素值。

→ = ± ... (10)

= ( )

→ ∙ → ... (11)

( ) = ( × × × ) ... (12)

3.5 相對方位參數多重解

藉由前述方法求解相對方位時會產生多重解 問題,此種情況發生於框幅式影像如圖 7 所示 (Hartley and Zisserman, 2004),可由物空間點 P 是 否位於相機之前方求定。然而對於全景影像而言此 種方式並不適用,因在球形全景影像上無法明確定 義前後方,球形全景影像多重解如圖 8 所示。

圖 7 框幅式影像相對方位多重解(Hartley and Zisserman, 2004)

圖 8 全景影像相對方位多重解

對此本研究提出適用於全景影像求解方法,當 兩全景影像相對方位關係建立後,於物空間中產生 物點 P(Lee et al., 2013)並計算兩攝影中心至物點 P 物點向量及像點 p 像點向量,計算此二向量夾角(檢 核角度),當兩張影像檢核角度皆趨近 0˚時,該組 解為正確相對方位關係,如圖 9 所示。

圖 9 檢核角度示意圖

3.6 尺度因子估計

當控制影像與查詢影像間相對方位建立後,尚 需決定尺度因子方能求解查詢影像絕對方位。若查 詢影像同時與兩張(含)以上控制影像匹配時,尺度 因子可由控制影像進行前方交會獲得,如圖 10 及 式(13)所示,其中 I1 及 I2 為控制影像,I3 為查詢 影像。當控制影像多於兩張時可由最小二乘平差求 得尺度因子最或是值,如式(14)所示。

圖 10 前方交會計算尺度因子

= + k ∙ ∙ = + k ∙ ∙ ... (13)

2 − 1 2 − 1 2 − 1

+ =

−

−

−

k

k ... (14)

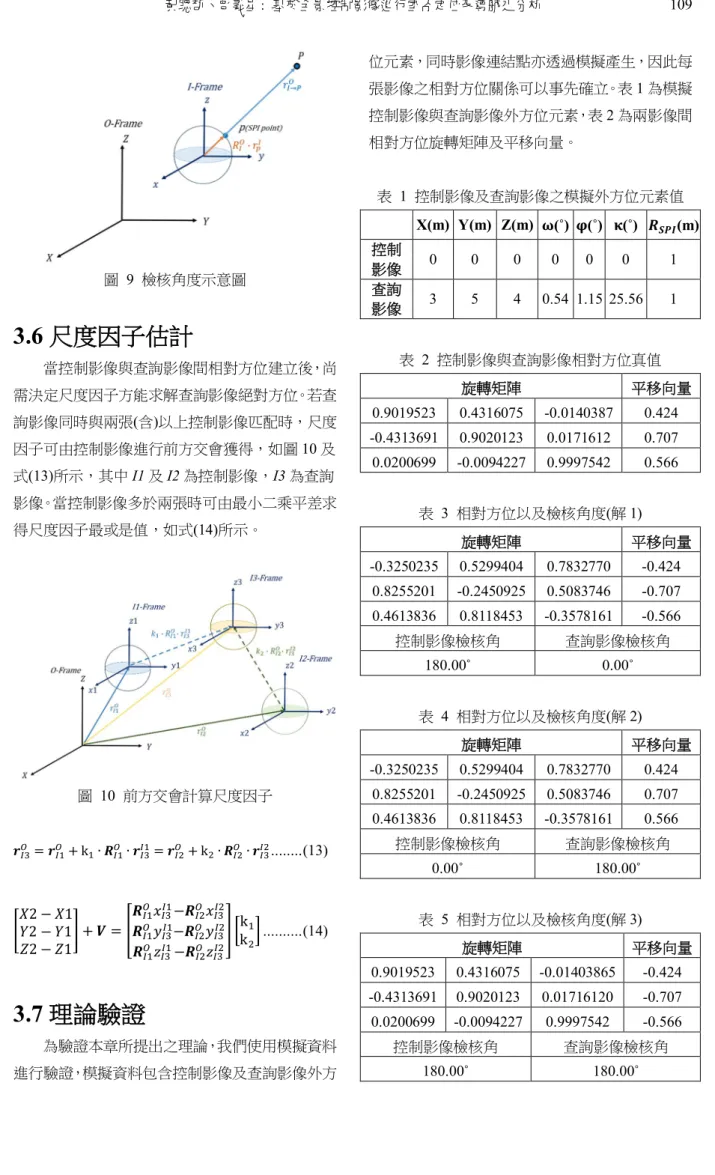

3.7 理論驗證

為驗證本章所提出之理論,我們使用模擬資料 進行驗證,模擬資料包含控制影像及查詢影像外方

位元素,同時影像連結點亦透過模擬產生,因此每 張影像之相對方位關係可以事先確立。表 1 為模擬 控制影像與查詢影像外方位元素,表 2 為兩影像間 相對方位旋轉矩陣及平移向量。

表 1 控制影像及查詢影像之模擬外方位元素值 X(m) Y(m) Z(m) (˚) (˚) (˚) (m) 控制

影像 0 0 0 0 0 0 1 查詢

影像 3 5 4 0.54 1.15 25.56 1

表 2 控制影像與查詢影像相對方位真值

旋轉矩陣 平移向量

0.9019523 0.4316075 -0.0140387 0.424 -0.4313691 0.9020123 0.0171612 0.707 0.0200699 -0.0094227 0.9997542 0.566

表 3 相對方位以及檢核角度(解 1)

旋轉矩陣 平移向量

-0.3250235 0.5299404 0.7832770 -0.424 0.8255201 -0.2450925 0.5083746 -0.707 0.4613836 0.8118453 -0.3578161 -0.566

控制影像檢核角 查詢影像檢核角

180.00˚ 0.00˚

表 4 相對方位以及檢核角度(解 2)

旋轉矩陣 平移向量

-0.3250235 0.5299404 0.7832770 0.424 0.8255201 -0.2450925 0.5083746 0.707 0.4613836 0.8118453 -0.3578161 0.566

控制影像檢核角 查詢影像檢核角

0.00˚ 180.00˚

表 5 相對方位以及檢核角度(解 3)

旋轉矩陣 平移向量

0.9019523 0.4316075 -0.01403865 -0.424 -0.4313691 0.9020123 0.01716120 -0.707 0.0200699 -0.0094227 0.9997542 -0.566

控制影像檢核角 查詢影像檢核角

180.00˚ 180.00˚

表 6 相對方位以及檢核角度(解 4)

旋轉矩陣 平移向量

0.9019523 0.4316075 -0.01403865 0.424 -0.4313691 0.9020123 0.01716120 0.707 0.0200699 -0.0094227 0.9997542 0.566

控制影像檢核角 查詢影像檢核角

0.00˚ 0.00˚

觀察表 3~6 可以發現表 6 之解 4 為正確解,其 旋轉矩陣與平移向量參數與真值相同,同時檢查檢 核角度於兩張影像上夾角皆為 0˚,可以證明本研究 所提出之方位計算理論以及多重解判斷方法可以 正確求解球形全景影像方位。

4. 球形影像匹配

4.1 影像匹配演算法

影像匹配及共軛點量測於本研究中為重要關 鍵,影像匹配演算法可簡單區分為區域匹配(Area Based Matching, ABM)以及特徵匹配(Feature Based Matching, FBM)(Joglekar and Gedam, 2012)。ABM 使用罩窗於影像上移動並算罩窗內影像相關係數,

然而 ABM 方法有其限制,如影像罩窗位置需給予 起始值,若起始位置不涵蓋影像重疊區,則影像相 關係數計算可能發散導致匹配失敗,本研究使用之 影像於匹配前方位關係尚未建立,因此 ABM 應用 於本研究有其困難性且不易實行。此外,本研究使 用球形全景影像旋轉、平移及尺度皆有變化,對此 ABM 不易克服此種問題。FBM 則是藉由偵測影像 特徵進行匹配及共軛點計算,較不易受前述限制所 影響,因此本研究採用 FBM 進行影像匹配及共軛 點量測,使用演算法為 Speed-Up Robust Features (SURF)(Bay et al., 2008),SURF 對於兩影像經旋轉、

平移或是放大縮小後,仍可進行共軛點偵測及匹配。

SURF 運算可區分三個部分,第一部分為特徵偵測,

第二部分為特徵描述,最後則是特徵匹配。

4.2 Random Sample Consensus

兩張影像經由 SURF 匹配後可以獲得共軛點

對座標,匹配完後必須進行匹配點剔錯,本研究使 用 Random Sample Consensus (RANSAC)(Fischler and Bolles, 1981)執行。基於 RANSAC 的基本原理,

應用於全景影像錯誤點對偵測第一部分運算為隨 機選取若干共軛點對並計算點對函數模型,重複此 步驟多次(使用者決定)後產生數個函數模型,透過 函數模型定義式可以選取出最佳函數模型,定義式 如式(15)所示(Stewénius et al., 2006)。接著進入第 二部分運算,逐點加入共軛點對至函數模型中並測 試該點對是否擬合函數模型,使用者設定合適門檻 值進行篩選,若新加入共軛點對不符設定門檻值則 予以剔除,反之將其視為正確共軛點對並加入原有 資料群集重新計算新函數模型,重複此步驟,直至 所有共軛點對測試完畢。

2 − ( ) = 0 ...(15)

4.3 函數模型

前述 RANSAC 中,必須從輸入資料群集中計 算數學函數模型,此函數模型為 RANSAC 偵錯關 鍵。框幅式影像間關係可以六參數(仿射)轉換描述,

透過仿射轉換計算座標差值,若差值小於設定之門 檻值,則可視為正確共軛點對。然球形全景影像投 影轉換關係為球形轉換,無法透過仿射轉作為偵 錯 函 數 模 型 , 因 此 本 研 究 以 本 質 矩 陣 作 為 RANSAC 偵錯函數模型,藉由本質矩陣進行轉換 計算共軛點對與兩攝影中心組成之平面是否符合 共面條件以濾除錯誤共軛點對。

5. 實驗設計與結果討論

本研究整體流程可透過圖 11 所示,首先建立 控制影像資料庫,這部分必須透過人工量測室內控 制點球形影像網形平差求得控制影像方位資訊,接 著利用影像自動化匹配及共軛點偵測求取控制影 像與查詢影像共軛點座標,此一部分為自動化進行,

檢核條件即為透過 RANSAC 評估共軛點品質。接 著利用本質矩陣以及奇異值分解的方式求得兩影 相之相對方方位資訊,本質矩陣可以透過共面條件

加以評估其正確性,此一部分亦為自動化進行,最 後透過前方交會的方式求得尺度因子進而得到查 詢影像之絕對方位。

圖 11 實驗流程及步驟略圖

5.1 實驗場地

實驗場地位於成功大學測量及空間資訊學系 系館,涵蓋 1、2 樓及樓梯。為了驗證實驗成果,

透過網形平差計算球形全景影像外方位元素。實驗 使用兩種不同共軛點資料,第一種為人工量測共軛 點對,第二種為使用 SURF/RANSAC 自動化匹配 共軛點。

5.2 實驗成果

5.2.1 手工量測共軛點對

本次實驗共拍攝 15 張全景影像,挑選 5 張影 像做為查詢影像並利用前述方法進行相對方位及 尺度計算,求得查詢影像絕對方位,表 7 為人工量 測共軛點方式獲取共軛點對進行後續方位解算成 果與網型平差結果比較。表 8 及表 9 為查詢影像編 號 2 與控制影像間相對方位旋轉矩陣真值以及計 算結果。

表 7 位置計算成果與已知值之殘差與精度評估 (人工量測)

影像編號 △X(m) △Y(m) △Z(m) 1 -0.002 0.027 -0.004 2 -0.007 0.001 0.002 3 0.045 0.007 0.014 4 0.302 0.052 0.126 5 0.040 0.038 0.002 平均誤差 0.076 0.025 0.028 均方根誤差 0.137 0.031 0.057

表 8 查詢影像編號 2 與控制影像相對方位旋轉矩 陣真值

旋轉角 (˚) (˚) (˚)

-6.50 0.92 89.87 相對旋轉

矩陣 (與控制影

像 10)

0.0419766 0.9866527 -0.1573355 -0.9966871 0.0303723 -0.0754478 -0.0696621 0.1599813 0.9846589 相對旋轉

矩陣 (與控制影

像 3)

0.0514589 0.9875579 -0.1485980 -0.9961762 0.0402392 -0.0775484 -0.0706040 0.1520204 0.9858524

表 9 查詢影像編號 2 與控制影像相對方位旋轉矩 陣計算值

旋轉角

(˚) (˚) (˚)

-9.45 2.73 62.30 相對旋轉矩陣(與控制影像 10)

0.4645855 0.7683399 -0.1454832 -0.8849033 0.4664603 -0.0458743 0.0476372 0.1472186 0.8845874

旋轉角

(˚) (˚) (˚)

-8.87 -3.39 86.71 相對旋轉矩陣(與控制影像 3)

0.0575872 0.9935010 -0.1484680 -1.0026157 0.0466836 -0.0751561 -0.0671802 0.1538422 0.9859558

5.2.2 自動化影像匹配

自動化匹配以 SURF/RANSAC 進行,包含選 取最多共軛點對之影像對及自動化量測共軛點座 標,表 10 為方位解算成果與網型平差結果比較,

平均誤差及均方根誤差未將查詢影像編號 4 納入 計算,透過自動化匹配定位平均誤差及均方根誤差 約 20 公分左右。表 11 及表 12 為查詢影像編號 3 與控制影像相對方位旋轉矩陣真值及計算結果。

表 10 位置計算成果與已知值之殘差與精度評估 (自動化匹配)

影像編號 △X(m) △Y(m) △Z(m) 1 0.011 -0.005 -0.016 2 0.448 -0.315 0.464 3 0.216 -0.030 0.050 4 -3.654 4.090 -0.097 5 0.138 -0.276 0.060 平均誤差 0.203 -0.157 0.140 均方根誤差 0.258 0.201 0.235

表 11 查詢影像編號 3 與控制影像相對方位旋轉 矩陣真值

旋轉角 (˚) (˚) (˚)

2.09 5.34 2.05 相對旋轉

矩陣(與控 制影像 10)

0.9999500 0.0092206 -0.0024579 -0.0092417 0.9999200 -0.0087257 0.0023773 0.0087480 0.9999600 相對旋轉

矩陣(與控 制影像 9)

0.9994700 0.0279130 -0.0170080 -0.0281810 0.9994800 -0.0157390 0.0165590 0.0162100 0.9997300

表 12 查詢影像編號 3 與控制影像相對方位旋轉 矩陣計算值

旋轉角

(˚) (˚) (˚)

-0.13 2.18 -2.40 相對旋轉矩陣(與控制影像 10)

1.0017000 -0.0416810 -0.0376630 0.0419840 0.9999100 -0.0067668 0.0381130 0.0022535 1.0018000

旋轉角

(˚) (˚) (˚)

-0.95 6.10 -4.54 相對旋轉矩陣(與控制影像 9)

1.0011000 -0.0829180 -0.1079900 0.0795190 1.0013000 0.0072074 0.1062900 0.0165310 0.9995200

5.3 分析與討論

由表 7 可以發現在進行方位解算時透過人工 量測共軛可以達到公分等級定位精度,雖然影像編 號 4 較其他成果不佳,對於室內定位仍足以應用。

以手工量測共軛點結合方位計算理論可達到約 10 公分均方根誤差值。比較表 7 與表 10 可以發現透 過自動量測共軛點的方式進行方位解算時,定位結 果殘差量有明顯提升,主要是因為相比於人工量測 共軛點,自動化量測共軛點測品質較差所致,據此 可知共軛點對量測品質對方位解算有所影響。針對 影像編號 4 較大位置殘差量,經過推論分析發現該 影像位於樓梯,與其他控制影像距離較遠,導致該 影像與控制影像間之共軛點對數量較其他影像對 稀少,據此證明共軛點對數量亦會對定位成果造成 影響。共軛點對的分布,由於受限於球形全景影像 在頂部及底部投影畸變量過大的情況下,使用自動 化共軛點匹配時無法有效的匹配出該區域之共軛 點,在室內環境中,頂部影像和底部影像多為天花 板或是地板,此二者多半為均調區域,對於影像共 軛點偵測有其限制,因此本研究並未針對共軛點對 的分布進行更深的探討。

影像姿態部分,觀察表 8 及表 9 可以發現查詢 影像編號 2 與控制影像編號 3 計算相對方位旋轉矩 陣與真值近似,因此旋轉角亦可控制於 3~5 度誤差 範圍內。然而,查詢影像編號 2 與控制影像編號 10 旋轉矩陣元素與姿態角和真值明顯不同,顯示 姿態角計算尚無法穩定求解。觀察表 11 與表 12 發現不穩定解於自動化共軛點對量測時亦會發 生。

有鑑於此,本研究對於計算所得相對旋轉矩陣 進行驗證,觀察計算所得旋轉矩陣發現元素值有大 於 1 的情況。根據旋轉矩陣定義,其矩陣內元素值 最大最小值應位於+1 與–1 之間。另一方面,旋 轉矩陣為正交矩陣,因此該矩陣與其自身轉置矩陣 乘積為單位矩陣,表 13 及表 14 為旋轉矩陣與其自 身轉置矩陣之乘積,雖然求解旋轉矩陣有不穩定或 是含有較大誤差之情形,根據乘積結果可知旋轉矩 陣特性不會因此而喪失。

表 13 查詢影像編號 2 旋轉矩陣與其自身轉置矩 陣乘積

查詢影像 2(與控制 影像 10)

0.8273513 -0.0460392 0.0065529 -0.0460392 1.0027435 -0.0140625

0.0065529 -0.0140625 0.8064375 查詢影像

2(與控制 影像 3)

1.0124033 -0.0001994 0.0025908 0.0001994 1.0130660 0.0004372 0.0025908 0.0004372 1.0002894

表 14 查詢影像編號 3 旋轉矩陣與其自身轉置矩 陣乘積

查詢影像 3(與控制 影像 10)

1.0065587 0.0006330 0.0003531 0.0006330 1.0016285 -0.0029255 0.0003531 -0.0029255 1.0050609 查詢影像

3(與控制 影像 9)

1.0207384 -0.0041976 -0.0029020 -0.0041976 1.0089769 0.0322085 -0.0029020 0.0322085 1.0106111

6. 結論與建議

本研究提出透過使用全景控制影像進行室內 定位演算法,建立控制影像資料庫計算使用者拍 攝全景影像座標及姿態。結合 SURF 與 RANSAC 演算法進行全景影像匹配作業,欲進行影像方位 計算必須仰賴高效率及高準確率的影像匹配及共 軛點自動量測,不同於框幅式影像的轉換關係,

全景影像投影關係較為複雜,本研究使用本質矩 陣作為 RANSAC 演算法函數模型,取代原本仿射 轉換模型。當全景影像正確匹配後,兩張全景影 像間相對方位亦可透過本質矩陣進行計算。利用 本質矩陣計算全景影像相對方位時會產生多重解 問題,本研究提出以檢核角度求解正確方位解並 成功克服全景影像多重解問題,最後透過至少兩 張控制影像前方交會可求得查詢影像絕對方位。

因此,使用全景控制影像進行室內定位及導航是 成功且可行的。雖然本質矩陣應用於全景影像共 軛點偵錯時有較佳表現,在進行影像匹配時,須 將球形全景影像投影至平面,因此在影像頂部區 域將因投影產生變形問題,導致 SURF 匹配錯誤

或是造成共軛點分布不均勻。

本研究實驗地點位於國立成功大學測量及空 間資訊學系系館 1、2 樓,使用 Ladybug 5 拍攝全 景影像 15 張,從中挑選 5 張作為查詢影像,共軛 點量測分成人工量測及自動量測。根據實驗結果 發現使用人工量測共軛點對進行計算查詢影像之 位置時定位誤差可控制在數公分內,透過自動化 匹配及量測共軛點對進行位置計算時,則定位誤 差亦能保持 20 公分左右,由此可推論共軛點對品 質影響定位精度,另一方面,觀察共軛點對數量 亦可發現若共軛點對數量稀少將導致定位精度不 佳,因此共軛點對數量亦對定位精度有所影響。

姿態角部分透過比較旋轉矩陣可發現目前尚 無法穩定求解,即某些情況可求得正確姿態角,

惟有時計算得不合理姿態角。對此,目前尚未有 造成不穩定解原因。根據 3.7 節之理論驗證模擬實 驗可知,若使用不含誤差共軛點對進行姿態角求 解,以本研究提出之方位解算理論可以成功求得 查詢影像與控制影像相對方位並透過座標轉換得 到正確姿態角。

參考文獻

Bay, H., Ess, A., Tuytelaars, T., and Gool, V.L., 2008.

SURF: speeded up robust features, Computer Vision and Image Understading, 110(3):

346-359.

Fischler, M.A., and Bolles, R.C., 1981. Random sample consensus: a paradigm for model fitting with applications to image analysis and automated cartofraphy, Comm. of the ACM, 24:

381-395.

Hartley, R., and Zisserman, A., 2004. Multiple View Geometry in Computer Vision, Cambridge University, pp.257-260.

Horn, B.K.P., 1990. Recovering baseline and orientation from essential matrix, Journal of the Optical Society of America, pp.1-10.

Joglekar, J., and Gedam, S.S., 2012. Area based

image matching methods – a survey, International Journal of Emerging Technology and Advanced Engineering, 2(1): 130-136.

Lee, Y., Lee, S., Kim, D., and Oh, J.K., 2013.

Improved industrial part pose determination based on 3D closed-loop boundaries, IEEE International Symposium on Robotics (ISR), pp.1-3.

Lin, K.Y., 2014. Bundle adjustment of multi-station spherical panorama images with GPS positioning, Master Thesis, National Cheng Kung University, Taiwan, ROC.

Longuet-Higgins, H.C., 1981. A computer algorithm for reconstructing a scene from two projections, Nature, 293: 133-135.

Scaramuzza, D., and Fraundorfer, F., 2012. Visual odometry: part I - The first 30 years and fundamentals, IEEE Robotics and Automation Magazine, 18(4): 85-87.

Stewénius, H., Engels, C., and Nistér, D., 2006.

Recent developments on direct relative orientation, ISPRS Journal of Photogrammetry and Remote Sensing, 60(4): 284-294.

Zhang, C., Xu, J., Xi, N., Jia, Y., and Li, W., 2012.

Development of an omni-direction 3D camera for robot navigation, IEEE/ASME International Conference on Advance Intelligent Mechartronics, Taiwan, pp.262-267.

1 Master Student, Department of Geomatics, National Cheng Kung University Received Date: Dec. 23, 2016

2 Professor, Department of Geomatics, National Cheng Kung University Revised Date: Mar. 14, 2017

* Corresponding Author, E-mail: [email protected] Accepted Date: May. 02, 2017

Indoor Positioning and Navigation Based on Control Spherical Panoramic Images

Tsung-Che Huang 1* Yi-Hsing Tseng 2

Abstract

The objective of this study is to develop a novel method of indoor positioning and navigation with the use of spherical panoramic image (SPI).Two steps are planned in the technology roadmap. Firstly, establishing a control SPI database that contains a good number of well-distributed control SPIs pre-acquired in the target space. A control SPI means an SPI with known exterior orientation parameters (EOPs). Having a control SPI database, the target space will be ready to provide the service of positioning and navigation. Secondly, the position and orientation parameters (POPs) of a newly taken SPI can be solved by using overlapped SPIs searched from the control SPI database.For validation, two kinds of corresponding points were applied in the experiment.The result of calculation were shown in this research including the analysis and discussion.

Keywords: Spherical Panorama Image, Indoor Positioning and Navigation, Image Feature Matching