國

立

交

通

大

學

電控工程研究所

碩 士 論 文

結合二維影像與三維點雲資訊之物體辨識

Object Recognition Using 2D Image and 3D Point Clouds Data

研 究 生 :牟 家 昌

指導教授:林 昇 甫 博士

結合二維影像與三維點雲資訊之物體辨識

Object Recognition Using 2D Image and 3D Point Clouds Data

研 究 生 :牟 家 昌

Student: Chia-Chang Mou

指 導 教 授 :林 昇 甫 博士

Advisor: Dr. Sheng-Fuu Lin

國立交通大學

電控工程研究所

碩士論文

A Thesis

Submitted to Institute of Electrical Control Engineering College of Electrical Engineering

National Chiao-Tung University in Partial Fulfillment of the Requirements

for the Degree of Master

in

Electrical Control Engineering June 2011

Hsinchu, Taiwan, R.O.C 中 華 民 國 一 百 年 六 月

i

結合二維影像與三維點雲資訊之物體辨識

學生 : 牟家昌 指導教授 : 林昇甫 博士 國立交通大學電控工程研究所碩士班摘要

近年來,在辨識三維物體的研究中,點雲資料逐漸成為重要的研究對象。在 不同的拍攝視角與不同的拍攝距離所選取的特徵,往往會直接影響辨識的成效。 為了解決這個問題,本論文提出一個整合型辨識系統,由不同距離所得到不同完 整度的影像,利用辨識策略的切換以達成兼顧不同距離時的辨識。在遠距離時, 採用傅立葉描述子作為形狀描述的特徵,以及視角內插法來提升辨識的正確率; 當距離足夠近時,由於塔台的輪廓線會越來越不具代表性,造成辨識的錯誤率增 加,故本論文採用一個結構描述子做為辨識時所使用的特徵,以點雲資料直接進 行辨識。本論文以十個不同的塔台模型,驗證本論文所提出的演算法。在遠距離 與近距離兩種不同的條件下,實驗結果顯示本論文所提的方法,在辨識率方面均 優於單獨使用距離影像或點雲資料所使用的特徵。 關鍵字 : 點雲資訊、距離影像、三維點雲辨識ii

Object Recognition Using 2D Image and 3D Point Clouds Data

Student : Chia-Chang Mou Advisor : Dr. Sheng-Fuu Lin

Submitted to Institute of Electrical Control Engineering College of Electrical Engineering

National Chiao Tung University

ABSTRACT

In recent years, research works of three dimensional object recognition in point cloud data become more and more popular. Appearance-based features, such as silhouettes of objects, will directly affect the recognition efficiency in different positions with various angles. To tackle this problem, this thesis proposes a recognition system with two-feature integration. One is the Fourier descriptor of the contour in a range image, and the other is the structure descriptor extracted from point clouds. The Fourier descriptor is used to identify an object in the far distance. Additionally, a method of view-angle interpolation is proposed to increase the correct recognition rate. The structure descriptor is used to recognize an object when closing to the object, since the contour information lacks the ability to describe the object. Furthermore, a strategy of proposed method is presented to select the appropriate feature for object recognition. Ten different control towers are used to verify the performance of the proposed approach. The experimental results show that the proposed system performs better than the method using only feature of range image or feature of point clouds data across the entire distance range.

iii

誌謝

首先要以最誠摯的謝意,感謝我的指導教授 林昇甫博士,感謝他在研究上的啟 發與指導,以及細心校閱本論文的繆誤之處,同時也要感謝本實驗室的學長晉嘉、 國育、士哲、永吉、啟耀、逸章、俊偉、道智、長安、煜維、昆義和,同學煒清、 世雄、家興、以及學弟們,有你們的幫忙才能在修課學習上不至於孤軍奮戰,更 有效率地解決修課上的問題,也由於你們熱心的協助與討論,使得研究過程中的 困境能夠迎刃而解。 最後要感謝疼愛我的父母,感謝他們的養育之恩以及在我求學生涯中給我最 大的鼓勵與支持,讓我得以順利完成學業。iv

目錄

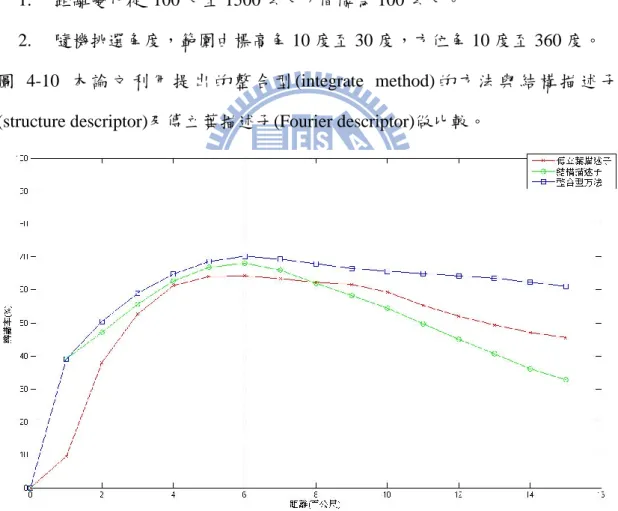

摘要…………...………...…i 英文摘要…………...ii 致謝………...…...iii 目錄………...…...iv 表目錄………...…...vi 圖目錄………...…...vii 第一章 緒論………...…1 1.1 三維物體辨識介紹………...…1 1.2 研究動機與背景...2 1.3 相關研究之探討………...…2 1.4 論文主體與貢獻……...……6 第二章 相關技術與原理………...…7 2.1 資料取得方式………...…7 2.2 採用距離影像時特徵擷取的方法及比對…...………9 2.2.1 輪廓提取…...………9 2.2.2 傅立葉描述子(Fourier descriptor) ...10 2.2.3 特徵比對…………...11 2.3 採用點雲資料時特徵擷取的方法及比對…………...11 2.3.1 主成分分析法…………...11 2.3.2 主曲率…………...12 2.3.3 形狀指標…………...16 2.3.4 區域成長法………...…17 2.3.5 圖(graph)的建立…………...18 2.3.6 圖形比對…………...18v 2.4 骨架化與骨架樹………...20 2.5 點特徵直方圖……… ...22 第三章 系統流程…………...24 3.1 整體辨識架構…………...24 3.2 辨識策略的切換…………...25 3.3 距離影像的辨識…………...26 3.3.1 特徵抽取(傅立葉描述子) …………...26 3.3.2 相似度比對…………...28 3.3.3 視角內插法…………...29 3.3.4 挑出候選模型...…………...30 3.3.5 找出候選模型的角度落點範圍及內插角度………...…...31 3.3.6 找出內插的影像及計算傅立葉描述子…………...32 3.3.7 進行比對……...…....32 3.3.8 非資料庫物體偵測………..….32 3.4 點雲資料的辨識…………...35 3.4.1 特徵抽取(結構描述子) …………...35 3.4.2 前處理…………...36 3.4.3 點雲分類…………...37 3.4.4 區域分割…………...38 3.4.5 圖形建立…………...40 3.4.6 相似度比對…………...47 第四章 實驗結果與分析…………...51 4.1 資料庫的建立…………...51 4.2 實驗結果與分析……...…...…54 4.3 結果討論…………...66 第五章 結論與未來發展…………...70

vi 參考文獻…………...71

表目錄

表 2-1 點屬性分佈。………..………16 表 3-1 修改後的點屬性分佈。………...……….37 表 4-1 估測後的三個角度。………66vii

圖目錄

圖 2-1 三維模型塔台。………...……….7 圖 2-2 模擬拍攝(側視圖)。………...………8 圖 2-3 模擬拍攝(正視圖)。………...8 圖 2-4 模擬拍攝後的結果 (a)距離影像、(b)點雲資料。……….9 圖 2-5 主曲率表示圖。………...14 圖 2-6 九種量化後的幾何分佈。………17 圖 2-7 圖的表示(a) 無向圖、(b) 有向圖、(c) 加權圖。………..18 圖 2-8 圖形比對的分類。………19 圖 2-9 圖 2-9(a) 原始影像,(b)骨架化後的影像。………..20 圖 2-10 圖 2-10 終點與接點在骨架上的表示。………20 圖 2-11 骨架樹的表示。………...………..21 圖 2-12 法向量的量測。………..22 圖 2-13 抽取特徵點,選取點對示意圖。紅點為域抽取特徵的點,水藍為半徑 r 內的點,其餘為半徑外的點。...22 圖 2-14 PFH 特徵抽取角度示意圖。………...23 圖 2-15 針對不同平面抽取 PFH 的結果。………...23 圖 3-1 辨識策略流程圖。………24 圖 3-2 距離影像的表示(a)完整的距離影像、(b)封閉的輪廓。……….……..25 圖 3-3 距離影像的表示(a)部份的距離影像、(b)不封閉的輪廓。………25 圖 3-4 距離影像的辨識流程圖。………26 圖 3-5 輪廓抽取的過程(a)3D 塔台模型、(b)對應的距離影像、(c)對應的輪廓…...27 圖 3-6 角度表示圖。………27 圖 3-7 特徵資料庫中某一個塔台模型所含的傅立葉描述子的特徵向量之示意 圖。…………...………..………..28viii 圖 3-8 在 6 個距離下,三種不同範數的比較。………29 圖 3-9 視角內插法流程圖。………30 圖 3-10 場景與資料庫的特徵向量經由比對後所產生的結果之示意圖。…………30 圖 3-11 直方圖表示對應的範圍。……….31 圖 3-12 每個群集中心對應新的內插角度示意圖。..………..31 圖 3-13 內插的流程。...………..32 圖 3-14 由左至右、由上至下分別為塔台編號 1 到 10,正確比對之對應不像似度 值。………33 圖 3-15 綜合 10 個塔台之正確比對所對應的不相似度值。….………33 圖 3-16 Z 函數之分佈情況 。...………34 圖 3-17 不包含在資料庫中的塔台模型。..………34 圖 3-18 輸入資料為點雲資料的辨識流程圖 。....………35 圖 3-19 建立結構描述子的流程圖。………..36 圖 3-20 法向量的表示。………..37 圖 3-21 點分類後的結果 (a)編號 1 之原始部分點雲資料,(b)圖(a)之分類結果, (c)邊號 10 之原始部分點雲資料,(d)圖(c)之分類結果。…………...……..38 圖 3-22 區域成長法流程圖。………..39 圖 3-23 點雲資料分割結果,不同區塊以不同的顏色區別 (a)編號 1 之塔台內部 點,(b)圖(a)之分割結果,(c)編號 10 之塔台內部點,(d)圖(c)之分割結果。...40 圖 3-24 結構抽取結果(a)、(c)、(e)表示分割面與邊在空間上的分佈關係,(b)、(d)、 (f)表示對應的圖形結構。………....41 圖 3-25 節點法向量表示 (a)區塊法向量,(b)對應區塊之節點法量。………...…42 圖 3-26 塔台最大主軸與節點法向量的夾角(a)塔台之最大主軸表示,(b)示意最大 主軸與對應區塊法向量的夾角。...43 圖 3-27 平面所對應的形狀指標 (a)點分佈為平面,對應圖(a)的形狀指標,(c)點 分佈為圓柱形,(d)對應圖(c)的形狀指標,(e)點分佈為圓錐形,(f)對應圖(e)的形

ix 狀指標為圓錐形,(f)對應圖(e)的形狀指標。...44 圖 3-28 相鄰節點之夾角。………45 圖 3-29 由邊的屬性所附屬的結構特徵(a)、(c)、(e)表示分割面與邊在空間上的分 佈關係,(b)、(d)、(f)表示不同的邊之連接關係。………...……46 圖 3-30 點雲資料下的特徵表示。………47 圖 3-31 子圖抽取的流程圖。………48 圖 3-32 經分割後所產生的子圖。………48 圖 3-33 比對流程圖。………50 圖 4-1 資料庫中 10 種塔台模型。………...51 圖 4-2 經由對稱性分析後得到之 72 張塔台編號 10 的資料庫影像。...…………..52 圖 4-3 點雲資料下的特徵資料庫。………53 圖 4-4 角度的選擇範圍。………55 圖 4-5 角度對於辨識的錯誤率。………56 圖 4-6 受遮蔽的情況(a)標高角 45 度之點雲分佈情況、(b)標高角 10 度之點雲分 佈情況。…...……57 圖 4-7 受遮蔽的情況(a)標高角 45 度之點雲分佈情況、(b)標高角 80 度之點雲分 佈情況。……...…58 圖 4-8 有無加入視角內插法之比較圖。...59 圖 4-9 傅立葉描述子與結構描述子之綜合辨識率比較。...59 圖 4-10 標高角介於 10 度至 30 度的綜合辨識率的比較。………60 圖 4-11 標高角介於 40 度至 80 度的綜合辨識率的比較。………61 圖 4-12 標高角介於 10 度至 80 度的綜合辨識率的比較。………62 圖 4-13 整合型方法與其它文獻的辨識率比較。………63 圖 4-14 細部放大。………65

1

第一章 緒論

本章分成四節,將三維物體辨識這個領域做介紹。首先,1.1 節將介紹三維 物體辨識( 3D object recognition )相對於二維影像辨識的優點,然後說明三維物體 資料的取得方式以及三維物體辨識的未來發展潛力;1.2 節將介紹三維物體辨識 的動機;1.3 節介紹本論文的架構,1.4 節說明本論文之貢獻。1.1

三維物體辨識介紹

以往取像技術的發展是取得二維影像為主,例如:灰階影像或是彩色影像, 使得影像辨識大多是從二維資訊中取得特徵並發展應用所需之演算法,像是文字 辨識、人臉辨識、指紋辨識、車牌辨識等方面,但礙於二維影像提供的資訊會因 為光源照射角度的差異以及光源強度不同,使得辨識效果不彰更嚴重可能導致無 法辨識出影像中的目標物體;然而,近年來隨著三維物體的取像技術越來越成熟, 使得以物體表面的三維資訊為基礎來進行物體辨識,在三維的取像設備大致上是 由雷射測距儀(laser range finder)來取得,而取得的資訊可分成兩大類,第一類為 距離影像(range image),在以往二維影像每個像素所含的內容為灰階值(gray level),但是在距離影像中每個像素所含的內容為測距儀到物體的距離,在藉由 這些距離轉換成相對於 0~255 的灰階影像,第二類為點雲資訊(point cloud data), 而此種資訊正如其名是將拍攝到的物體利用點得方式來呈現,點雲中每點的資訊 描述正是三維空間中的座標,其點與點的對應位置就是真實空間中的對應位置。 一般二維影像只能提供以真實世界投影在影像平面上的資訊基於物體表面 的反射特性,來獲得物體的輪廓、邊界、紋理等特徵,但是以二維資訊為基礎的 辨識演算法來辨識出實際的三維物體時,會產生許多問題,因為光源照射角度的 差異及光源強度不同,以致於針對同一場景,會獲得不同的二維資訊,使得辨識 率不穩定或是效率較不佳;然而,相較之下,如果能直接取得場景的三維資料來 進行物體的辨識,相對於二維資訊,三維資訊能更準確的描述物體的外觀以及物 體的幾何資訊。2 雷射測距儀被廣泛的應用在距離量測、地型地貌的監測、建築物的量測、三 維立體物體的量測等。藉由雷射測距儀也可得到物體的輪廓、邊界、紋理等;這 些影像資訊目前有被應用在機器人視覺,地形變化的量測,機械機密定位以及生 物立體影像的重建等。

1.2

研究動機與背景

在本論文中,將結合距離影像與點雲資訊設計出一個三維物體辨識系統,將 應用在機場塔台的辨識上,而本論文則架構在單一塔台上做辨識,故不需做場景 分割的動作,但是在擷取塔台的影像資料上將會隨著距離而改變,以距離影像來 說,距離越來越遠則影像將會越來越小,以點雲資訊來說,距離越來越遠則點雲 分佈在物體表面將會越來越稀疏,這對辨識上都是一大考驗,且在三維的物體辨 識中,特徵的選取必頇要符合尺度不變性、平移不變性及旋轉不變性,如此一來 才能夠形成強健的辨識系統,本論文旨在設計一個辨識系統,能夠符合三大不變 性,且對距離遠近變化下的辨識率能夠有好的表現。1.3

相關研究之探討

在本論文中,將採用距離影像及點雲資料做為辨識時所使用的資訊,由於拍 攝距離與測距儀能否拍攝到完整的塔台有密切的關係,則本論文將利用是否有擷 取到完整的塔台,做為辨識策略要採取距離影像或是要採取點雲資料,若是距離 足夠遠以致於雷射測距儀能拍攝到完整到塔台,則將採取距離影像,反之若是距 離過近以致於無法拍攝到完整的塔台,則將採取點雲資料。 不管在距離影像或是點雲資料的辨識方面,要辨識出場景中塔台對應資料庫 中哪種模型,將比對兩個物體所抽取出的特徵相似度,然而,特徵可分為全域特 徵(global feature)、區域特徵(local feature),當然,不同的應用會需要不同的特徵 來做為辨識的依據,這些特徵必頇具備有(1)旋轉不變性(rotation invariant),(2) 平移不變性(translation invariant),(3)尺度不變性(scale invariant)用以克服在不同 距離時影像尺度的不同,或是在不同角度拍攝下所產生影像旋轉的問題。三維物3 體辨識的主要目的,是以物體的三維資訊為基礎來進行辨識,將複雜場景中的未 知物體,與資料庫中的已知物體進行比對,進而辨識出該物體。主要的比對方式 是根據物體表面的特徵是否相符,以決定兩物體是否相同。首先,本論文模擬雷 射測距儀拍攝到塔台,可同時得到距離影像及點雲資料做為系統的輸入,在分別 對這兩種資料型態作特徵抽取。 基於全域特徵的辨識演算法,例如:D. S. Zhang 及 G. J. Lu 等人提出傅立葉 描述子(Fourier descriptor)[1],則是根據物體輪廓對其做傅立葉轉換所成的特徵, 相較於傅立葉描述子是描述物體輪廓得部份,W. Y. Kim, Y. S. Kim 等人所提出 的則奈克矩描述子(Zernike moment descriptor)[2] 則是用來描述物體的內容部份, 對於物體利用傅立葉描述子當特徵時,由於只有考慮到輪廓的部份,故忽略的物 體內容的部份,而物體利用則奈克矩描述子當特徵時,卻只有考慮到內容的部份, 忽略了物體輪廓的部份,所以 D. S. Zhang 及 G. Lu 等人[3]又提出傅立葉描述子 結合則奈克矩描述子做為描述物體的特徵,其效果比起只有使用單一描述子時好, 由 R. Osada 等人[4]所提出之形狀分佈(shape distributions),屬於全域特徵的方法, 其特性為運算簡易,能容忍雜訊且不需做特別的處理就有旋轉不變性,但缺點就 是鑑別度不高,完全不同的物體卻有可能會有相似的特徵。此方法以形狀分佈作 為特徵表示,使用幾何形狀函數(shape function)把三維模型中的形狀轉為機率分 佈,再以簡單數學比較兩個模型的特徵分佈曲線,其作法首先藉由統計模型中每 一個面的面積,並基於其面積大小隨機取出適當的點位置做為整體模型的代表點, 然後隨機以這些點的組合的幾何形狀函式作為特徵,不過本論文有運算時間上的 考量,故在特徵的選取上必頇具備運算時間短,且辨識率能達到一定的水準。 基於區域特徵的辨識演算法,像是 A. E. Johnson 等人所提出的旋轉影像 ( spin image )[5],相對於全域特徵的特徵表示法,區域特徵在特徵的描述上更具 有彈性,因為只要物體表面上的點與鄰近點之間相對關係沒有改變,即使對於不 同尺寸的同樣物體,也會具有相同的特徵。這是一種與目標物姿態無關的表面特

4 徵,其做法乃是利用許多方向點( oriented point )作為基準點,來計算物體的表面 特徵。由於旋轉影像是使用局部座標,對該物體表面上的所有點來進行編碼,因 此取得的特徵,不會因為物體在三維空間中姿態的不同而改變,但由於旋轉影像 是針對物體表面上的每一個頂點都做特徵表述,最後每一個點將依據其鄰近點的 幾何關係建立出對應的旋轉影像,而在比對時是採用每點與每點的旋轉影像進行 比對故資料量十分龐大,也造成計算上龐大的負擔,而 C. Dorai 及 A. K. Jain 等 人所提出的形狀指標(shape index)[6],也是根據物體表面變化作為特徵抽取的基 礎,將一個三維物體表面之組成採用以自由曲面(free form)的方式來描述,能真 實的描述物的表面組成,然後抽取出物體表面的幾何特徵,作為特徵比對用,而 文獻[19]不僅使用形狀指標且加入了角度變化,以及每點像素的深度變化,再利 用一個高維度的直方圖來做為特徵的表現。 在結構特徵的表示上,T. J. Fan 與 G. Medioni 等人[7]所提出之方法乃是利 用圖(graph)的方式來做特徵的描述,其作法則是在距離影像下實現,基於圖所建 立的特徵則是利用一組節點 (node)與邊(edge)的構成來描述物體的幾何結構 (geometric structure),而[6]則是先將物體進行分割,利用找出物體的邊將每個獨 立出來的區塊可能是平面或是曲面作為圖的節點,則圖的邊乃是根據在物體上兩 個獨立相鄰的區塊所共同擁有的邊作為圖中連結節點與節點的邊,當圖建立完成 後必頇賦予節點與邊一些屬性(attribute),這些屬性的賦予當然是有利於在進行比 對時所使用,S. Biasotti 與 S. Marini 等人在文獻[8][9]中利用理布圖(Reeb graph) 的建立將三維物體分割成幾個補丁(patch),然後再將一個補丁視為一個節點,理 布圖是由定義於模型上的連續函數所確定的骨架,是由形狀與拓樸(topology)表 示的基本數據結構,理布圖的思想在三維模型上定義一個連續函數 f,首先計算 每個頂點的 f 函數值,然後根據 f 值將模型上的頂點進行分類,f 值相同的且位 於同一連通分量上的點歸為一類,最後得到原頂點集的一個商集,將商集中的點 根據原有模型點間的鄰接關係連接起來,可得原有模型的一個架構,而此利用理

5

布圖的這個演算法,大多都在找尋一個好的 f 函數來對模型進行分割,依據不同 的的 f 函數可得到不同的理布圖,在三維空間中所挑出之理布圖仍然要符合旋轉 不變性、尺度不變性、及平移不變性,而在賦予節點的屬性上採用 M. Kazhdan, T. Funkhouser 等人[10]所提出之全域球諧波特徵(global spherical harmonic feature), 其特徵主要以球諧波函數(spherical harmonic function)為基礎,不考慮物體表面上 點與鄰近點之相對關係,只考慮物體的整體形狀,將物體的表面上的點利用體素 (voxel)推積方式來表示。之後利用類似傅立葉轉換法(Fourier transform),用一組 正交函數去近似每個有著固定半徑的球面其所涵蓋的體素數量。這樣表示法的優 點是考慮到物體部份的表面的整體形狀,但是會因為量測視角的些微差異,使得 物體的部份表面的整體形狀會有很大的差異,會受到異體姿態變化的影響很大, 最後在利用圖比對(graph matching)的方式來完成比對的程序,H. Sundar 等人[11] 則 是 利 用 骨 架 的 方 式 來 達 成 圖 的 建 立 , 輸 入 為 一 個 三 維 的 體 積 模 型 (3D volumetric model),經過細線(thin)化、分群(cluster)、連接(connect)後得到一個三 維線(3D line),而這個三維線可形成一個圖,用來表示這個物體的形狀,然後再 經過圖比對去找出相似的物體,但是在本論文中的資料型態為距離影像及點雲資 訊,且所得到的拍攝資料為部分的,故無法經由細線化來得到圖的表示,A. Bucksch 與 H. A. Wageninegn[12]所提出的方法也是利用骨架的方式來達成圖的 建立,且輸入的資料為點雲資訊,在骨架化的過程是先產生八元樹(octree),接 下來從這些八元樹細胞(octree cells)抽取出一個圖,最後將圖有封閉的部分去除, 最後也可得到一個三維的線做為圖的表現,不過利用八元樹將點雲資料轉換成體 積模型將會增加運算時間,在利用形狀結構描述子在電腦視覺中已經被廣泛的被 應用,中軸轉換(medial axis transformation)[13],其提供了一個形狀突起的分解法, 藉由在形狀內不同半徑的球來偵測的動作,中軸對於人的形狀比對上提供了一個 很好的直覺性特徵,特別在二維圖像的表現上更是有好的效果,Zhu. X[31]中提 出利用骨架抽取搭配支持向量機(support vector machine)來對物體做辨識,而在

6 [8][9][11]所使用的影像都是需要為完整的資訊,故在只有部分影像的場景上並無 法使用,相較於旋轉影像是以某點與鄰近點的幾何關係所做出的特徵,形狀指標 則是以某個區域的表面幾何變化所成的特徵。

1.4

論文主體與貢獻

本論文在辨識策略方面,提出整合型方法,是採用距離影像及點雲資料兩種 資料型態來做辨識,而選擇哪種資料型態作為辨識用的基礎,將依據物體與雷射 測距儀的距離來得知是否要切換方法,而切換得時機則是根據雷射測距儀是否有 拍攝到完整的物體,若是有拍攝到完整的物體則採用距離影像作為基礎,反之則 採用點雲資料作為基礎。 本論文貢獻一 : 基於距離影像作為辨識基礎時,本論文採用傅立葉描述子 作為在距離影像在比對時所使用的特徵,以及提出視角內插法做補償改善了單獨 使用傅立葉描述子的辨識率。 本論文貢獻二 : 基於點雲資料作為辨識基礎時,由於雷射測距儀與物體的 距離以足夠近,導致無法擷取到完整的物體樣貌,因為傅立葉描述子是一個全域 的特徵,故比對效率將隨著物體與雷射測距儀越來越接近而越來越低,此時本論 文提出結構描述子的方式來做為在點雲資料下進行比對時所使用的特徵,而本論 文所提出的結構描述子為一區域特徵,故其在近距離的比對效率比傅立葉描述子 好。 本論文貢獻三 : 提出一個整合型辨識系統,可根據雷射測距儀與物體的遠 近對於擷取影像的完整度,做辨識方法的切換,且能達到即時辨識的效果。7

第二章 相關技術與原理

本章第一節先介紹如何取得深度影像( range image )與點雲資料( point clouds data ),第二節介紹在距離影像辨識策略下本論文所使用的特徵擷取的方法以及 如何利用這些特徵進行特徵比對,第三節介紹在點雲資料辨識策略下本論文所使 用的特徵擷取的方法以及如何進行特徵比對,第四節將介紹如何切換不同的辨識 策略。

2.1

資料取得方式

本論文是透過模擬雷射測距儀的拍攝方式來取得深度影像與點雲資料,透過 雷射測距儀的拍攝可同時得到深度影像與點雲資料,由圖 2-1 表示完整的塔台模 型,本論文之場景拍攝與資料庫的建立都需透過這些模型來得到,圖 2-2 表示模 擬雷射測距離拍攝時的側視圖,而圖 2-3 表示模擬雷射測距離拍攝時的正視圖, 圖 2-4(a)表示經由雷射測距儀拍攝後所得之距離影像,而圖 2-4(b)表示經由雷射 測距儀拍攝後所得之點雲資訊。 圖 2-1 三維模型塔台。8

圖 2-2 模擬拍攝(側視圖) 。

9 (a) (b) 圖 2-4 模擬拍攝後的結果 (a)距離影像,(b)點雲資料。

2.2

採用距離影像時特徵擷取的方法及比對

本論文在採用距離影像作為辨識基礎的特徵擷取方法是基於文獻[1]的方式 來進行,在傅立葉描述子的部份本論文會先將深度影像轉成二值化影像,以方便 做輪廓的提取,以下先介紹為了傅立葉描述子所要先做的輪廓提取的方法。2.2.1

輪廓提取

輪廓抽取(contour extraction)的目的就是為了要獲得影像的外部輪廓,但是不 要影像內部的邊(edge),輪廓抽取是為影像形狀分析做準備,在本論文則是為了 利用傅立葉描述子來分析物體的輪廓。輪廓提取的方法有很多種,如梯度法,或 者是用型態學先對影像進行腐蝕,在藉由原影像減去腐蝕後的影像,則由於本論 文是採用二值化影像作為基礎,故在輪廓抽取部份是利用輪廓追蹤法,如此一來 可把輪廓點先做排序,而不需要再抽取輪廓後再重新排序。 基於輪廓追蹤法本論文是參考[14]的方式,首先找到第一個起始點A ,定義0 初始的搜索方向為沿左上方,如果左上方為黑點則為邊界點,否則搜索方向順時 針旋轉 45 度,直到找到黑點,然後把此點定為A ,並把當前搜索方向逆時針旋1 轉 90 度,繼續尋找下一個黑點,直到找到第一個初始點,則結束追蹤。10

2.2.2

傅立葉描述子( Fourier descriptor )

傅立葉描述子是一種以輪廓特徵為基礎的特徵抽取方法,在 2D 圖像檢索中 已經是很有效的一種方法,其可經由正規化(normalization)使其特徵具有平移, 旋轉,尺度大小具有不變性,而在文獻上也有討論抽取不同傅立葉特徵,也會有 不 同 的 檢 索效 果 ,其中 依 照 其 採取 的 特徵可 分 為 中 心距 離 傅立葉 (centroid distance Fourier),面積傅立葉(area Fourier),角度傅立葉(angular Fourier),複數 平面傅立葉(contour complex Fourier),極座標傅立葉(polar Fourier)和綜合角度和 中心距離傅立葉(angular radius Fourier),這些不同特徵的傅立葉抽取方式在[13] 都有說明,但在文獻上[1][2][3][15]的探討中,中心距離傅立葉相對於其它方法 是比較常被拿來使用的,且本論文利用中心距離傅立葉的效果較好,故在抽取特 徵方面是採取中心距離傅立葉作為特徵,則中心距離傅立葉是根據中心距離函式, 就是以物體上輪廓每一點到物體中心的距離來表示,而利用中心距離法可使此特 徵具有平移不變性,定義如下: ( ) (( ( ) ) ( ( ) ) ) , 1,..., , 2 / 1 2 2 N b x b y x b x b r c c (2.1) ( ), 1 , ) ( 1 1 0 1 0 N b c N b c y b L y b x L x (2.2) )) ( ), ( (x b y b 為物體上輪廓上的一點,(xc,yc)為物體的中心點, N 為邊界點的總 數,當中心距離函式設定好之後,接下來就是對其函式作傅立葉轉換,定義如(2.3) 所示: 1 ,..., 1 , 0 , ) 2 exp( ) ( 1 ) ( 1 0 N n N nk b r N n F N b , (2.3) 其中F(n)也就是r(b)的傅立葉轉換後的值。其中為了使每項係數都能具有旋轉 不變性,故取F(n)的大小 F(n) ,而不考慮正負。其次為了使傅立葉描述子具有 比例大小不變性,要針對複數特徵時把每項F(n)除以F(0),定義如下所示: ) F( F(L) ) F( ) F( ) F( ) F( Fd 0 0 2 0 1 , , , , (2.4)11 其中 L 為自定的一個常數,L 越大代表特徵為度越高,但只能取 2 N L 個特徵維 度,因為 2 N L 以後的特徵值是重複的,所以並不需要。

2.2.3

特徵比對

要如何評判在資料庫中的模型與未知的場景模型是否相同,通常都是透過相 似度分析,但是在文獻上的探討大多是利用差異度(dissimilarity)來表現,兩物體 越相似則差異度越小,反之則差異度越大。 而在進行特徵比對時,最常使用的就是利用範數距離(norm)

n n i i y x d 1 , (2.5) 2 n 時為歐基理德距離,是最常使用的距離標準,在比對時通常都是直接採取 找到最近的距離,也就是差異度最小的做為正確找到物體的依據,由於本論文將 應用在物體辨識上,因為物體形狀上的相似度滿高的,故只利用最相似的物體作 為評判往往都會產生誤判的情況,導致辨識度嚴重下降的原因,故本論文在此提 出兩階段的辨識比對方法,第一階段先利用範數距離的比對方式找出前幾名最相 似的物體,第二階段則是利用視角內插法找出後選物體之距離影像所對應的特徵 後,然後再利用這些特徵來做內插。2.3

採用點雲資料時特徵擷取的方法及比對

在空間上的點雲資料是無序的,比較簡單的來說就只是一群點資料在空間上 的分佈,單獨看每點資訊只有空間中的位置(x, y, z)值,但是這群點資料分佈在物 體的表面,所以可以透過一些幾何上的分析,每一個點資料在當前空間中與鄰近 點資料一起分析後可得知是甚麼形狀或是含有其它資訊,本論文在點雲資料做特 徵擷取的方面則是基於圖(graph based)的建立來實現,並利用圖比對的中的不完 全比對(inexact matching)來進行兩個圖的比對。2.3.1

主成分分析法

12

得到點資料的主軸分佈可經由主成分分析法來達成,首先針對某點 p 找出i

其鄰近點,可用最近點收尋法(nearest neighbor search)來做,對找出的鄰近點集合 抽取出兩個量,第一個為群集中心c ,第二為對應的相關矩陣(correlation matrix)i i C 分別定義如下所示: i i N q i i i q N c 1 , (2.6)

T N q i i i i i i i i c q c q N C 1 , (2.7) 為鄰近點集其中一點 為轉置, 為鄰近點集各數, 其中Ni T qi ,而相關矩陣中的 特徵向量{e0,e1,e2}對應的特徵值{0,1,2},其中012,故0對應的特徵 向量為法向量也就是三大主軸中最小的主軸分佈,1對應的特徵向量則為第二主 軸,然後最大的主軸分佈即為3所對應的特徵向量,在文獻[16][17][18]則根據這 些特徵值的分佈,依據不同的幾何分佈會對應不同的特徵值分佈,進而將當前pi 分類成邊界點(boundary)、邊緣點(edge)、內部點(interior)、邊角點(corner)等的屬 性。2.3.2

主曲率

在微分幾何中,在曲面給定兩個主曲率用來衡量在某點 P 的曲面在此點不同 方向下所產生怎樣不同彎曲的程度。在主曲率的分析上,由於某點與鄰近點幾何 關係的不同可對曲面的分類做解析: 1. 橢圓型 : 兩個主曲率有相同的符號,則曲面是局部击點。 2. 雙曲型 : 兩個主曲率符號相反,則曲面是局部鞍形。 3. 臍點 : 兩個主曲率有相同的值,且任意切向量可作為主方向,這通常出現在 離散點。13

4. 拋物型 : 一個主曲率為零,另一個主曲率非零。 5. 平臍點 : 兩個主曲率皆為零。

主曲率的定義如下所示:

主曲率k 及1 k2可由微分幾何中的第一基本式(first fundamental form)與第二基 本式(second fundamental form)所推得,第一基本式表是曲線的弧長,而第二基本 式則表示近似的表示曲面離開切平面的程度,進而表示曲面在空間中的彎曲程度, 第一基本式中利用I(u,v)u,v 做為表述, 3 ,v R u 向量 ,設X(u,v)為參數面 (Parameter Surface),則此參數面的切向量內積會滿足下式 v u v u v u v v v u bX cX dX ac X X ad bc X X bd X X aX I( , ) , ( ) , , EacF(adbc)G b d, (2.8) v u X 及X 為點( vu, )在參數面上之切向量,aXu bXv與cXu dXv為X 及u Xv的線 性組合,其中X 表示u 對u偏為分,Xv表示對v偏為分,可推得第一基本式的係 數 Xu Xu E , , (2.9) v X X F u, , (2.10) v X X G v, , (2.11) 根據上述原理本論文先定義參數面為r(u,v) (u,v,S(u,v))其中S( vu, )為一多項式曲面 表示成S(u,v) c0 c1vc2uc3vuc4v2 c5u2c6uv2 ...,則分別對u,v偏微分得 ru|(0,0)(1,0,c2c3v2c5u...)|(0,0)(1,0,c2) , (2.12) rv|(0,0)(0,1,c1c3u2c4v...)|(0,0)(0,1,c1) , (2.13) 2 2 1 ,r c r Eu u , (2.14) F ru,rv c1c2 , (2.15)

14 2 1 1 ,r c r Gv v . (2.16) 曲面的第二基本式: 設曲面 S 的方程為rr( vu, )為二次可導函數,即r( vu, )有連續的二階導函數 uu r 、ruv 、 rvv。現在固定曲面上一點P( vu, )並設T 為曲面在S P點的切平面。 曲線(C):uu(s),vv(s),或是rr[u(s),v(s)]是 S 上過P點的一曲線,其 中s是自然參數設P是曲線(C)上在P點鄰近的一點,P和P點的自然參數的值 分別為s與ss,即P點的向徑為r(s),P點的向徑為r(ss),利用泰勒展 開式可以得: 2 ) )( ( 2 1 ) ( ) (s s r s r s r s r P P , (2.17) 其中lim 0 0 s 。設 n 為曲面在P點的單位法向量,由P 作切平面T 的垂線,垂足S 為 Q,則QPn,其中為從切平面T 到曲面 S 的有向距離,如圖 2-5 所示: S 圖 2-5 主曲率表示圖。 由於QPn0,nr0,所以

15 , ) )( ( 2 1 )] ( ) ( [ ) ( 2 s n r n n s r s s r n P P n P P QP n P Q 由於 v r u r r u v ,rruuu rvvv 2ruvuvruurvv 2 2 , 又因為 0 ru n ,nrv 0, 所以 2 2 2 2n r dudv n r dv du r n ds r n uu uv vv , (2.18) 引進符號 n r L uu ,M ruvn,Nrvvn, 前式改為 II nd2r Ldu22MdudvNdv2, (2.19) (2.19)式稱曲面的第二基本式,係數 L、M、N 稱為曲面的第二基本量,得知第 一基本式的係數 E、F、G 及第二基本式的係數 L、M、N 後可得兩個曲率,高 斯曲率以及平均曲率。 高斯曲率: 2 2 F G E M N L G =k1k2, (2.20) 平均曲率: 2 ( ) 2 2 F G E L G M F N E H = 2 2 1 k k , (2.21) 則可推得 G H H k1 2 2 ,k2 2H H2 G,

16 令k1 kmax(p),k2kmin(p)則 G H H k1 2 2 , (2.22) G H H k2 2 2 , (2.23) 本論文根據上述原理將其分類成: 1. 臍點且分佈曲面為橢圓型 : 击邊角(convex corner)。 2. 臍點且分佈曲面為雙曲型 : 凹邊角(concave corner)。 3. 拋物型 : 邊緣(edge)。 4. 平臍點 : 平面(interior)。 經由上述分析可得到在邊角點的判定中可藉由正負符號的差異來區分击點或 凹是點,而在 Interior 並不需要考慮k 及1 k2的正負符號,只需考慮大小分佈即可, 本論文根據上述每一種類別都有不同的k1、 k2分佈將其歸納如下表 2-1 所示。 表 2-1 點屬性分佈。 2 1andk k 平面(interior) k10andk2 0 邊緣(edge) k 0and k 0or 2 1 k1 0andk2 0

击角(convex corner) k10andk2 0andk1k20or

0 0

0 2 1 2

1 andk andk k

k

凹角(corner concave) k10andk2 0andk1k2 0or

0 0 0 2 1 2 1 andk andk k k

2.3.3

形狀指標(shape index)

由[6]所提出之形狀指標,其主要用意在於量化一個三維空間中面的幾何分 佈,因為這個面可能是曲面可能是平面,也有可能這個面同時包含了許多不同的17 幾何分佈,對此[6]提出 9 種幾何分佈量化後的結果如圖 2-6 所示。 圖 2-6 九種幾何分佈。 而這些量化後的值就是形狀指標,要計算這些形狀指標前必頇先計算主曲率, 而主曲率可由 2.3.1 節中介紹的算法來達成,而形狀指標的定義如(2.24)所示: ) ) ( ) ( ) ( ) ( ( t a n * 1 2 1 ) ( 2 1 2 1 1 p k p k p k p k p SI ,k1 k2. (2.24) 而[17]則利用形狀指標搭配法向量以及每一個像素的影像深度做為一個多 維度直方圖的特徵,然後在利用這個特徵進行辨識。

2.3.4

區域成長法

經由分類後,可以得知每一個點是屬於平面點或是邊緣點或是其它屬性,再 來就是利用這些點資料的特性進行分割的動作,在文獻[21]提到許多不同的分割 方法,而本論文採用區域成長法[20]來做為分割點雲的依據,區域成長法的概念 即為利用某一種子點 P 做為搜尋的起點,向外搜尋 K 個最近的鄰近點,根據其 種子點與鄰近點的相似度作為是否合併的依據,若是鄰近點與種子點相似則合併, 反之則不合併,此時這些鄰近點將繼續向外搜尋 K 個最近的鄰近點直到無法繼 續搜尋到可合併的鄰近點時將停止搜尋,並將這些由種子點 P 所合併的點歸納成 同一群,然後再產生新的種子點 P 繼續搜尋並合併,直到每一個點都走訪後程式 結束。 區域成長法的優點就是演算法簡單,及其運算速度快,但是在目前而言,種18

子點的選擇上並沒有一個很好的歸納說明如何挑選出最好的種子點用以分割上 是最好的,故本論文在點資料的合併上則是依據點的屬性要為內部點,點與點的 法向量的夾角和點與點的距離不能超過某個閥值。

2.3.5 圖(graph)的建立

一個圖(graphs) G 是由節點(node)集合 N 和邊(edge)集合E共同組成,記為

G = (N, E),而圖的分類上又可根據邊是否具有方向性分成有向圖及無向圖,有 向圖為邊(x,y)不等同於邊(y,x),而無向圖則為邊(x,y)等同於邊(y,x),圖的邊除了 表示兩頂點的連結特性以外,另外若包含加權值(weight),則此圖就可稱為加權 圖,在圖形理論(graph theory)中,若是一個圖 G的節點 N與邊E為一個圖 G 節 點 N 與邊E的子集合則稱 G為 G 的子圖(sub-graph)。 (a) (b) (c) 圖 2-7 圖的表示(a)無向圖 (b)有向圖 (c)加權圖。

2.3.6 圖形比對 (graph matching)

由[22]中對圖形比對上做了大略的分類由圖 2-8 所示,在比對上可以分作 完全比對與不完全比對。 給定兩個圖形GM (NM,EM)及GS (NS,ES)且 NS NM ,則若是問題在 於找尋一對一的映射 f :NS NM,當(u,v)ES且( f(u),f(v) )EM,則這個問 題就稱之為是完全比對。 則在不完全比對的問題中,給定兩個圖形GM (NM,EM)及GS (NS,ES)且 M S N N , 目 標 在 於 找 出 一 個 映 射 關 係 f:NS NM ,當(u,v)ES且19 M E v f u f( ), ( ) ) ( ,而這個關係是說明從大的圖形G 中找出一個最小的相應於M S G 的圖形,圖形比對可被看作是一個最小化[23]的問題,它可被表示成下列式子: Ns x e E s m N N f e Ces x Cns f r( ) ( ) ( ), : . (2.25) 的節點 資料庫中某個 場景的節點,Nm: odel : s N m 。 有相連節點的邊 e: 。 節點的誤差 場景節點與 odel Cns: m 。 邊的誤差 場景邊與 odel Ces: m 。 而(2.25)式之誤差和的最小值就是最後匹配的結果,要計算上述誤差就必頇 賦予這些 node 與 edge 有意義的表示,這些表示可能是個值或是形狀等等,而且 這些表示頇具備旋轉不變性、平移不變性。這些表示用在節點稱節點屬性(node attribute)記作V,用在邊則稱邊屬性( edge attribute)記作E,若是一個圖的節點 及邊皆賦予屬性,則此圖也稱為加權圖(attribute graph)記作G(V,E,V,E),雖 然有這兩種比對問題,但是不完全比對的方法較合乎於實際的應用上,本論文取 得的點資料都呈現部份的分佈,所以在場景節點的取得上也會比資料庫的模型節 點來的少,故不完全比對較合乎於本論文的需求。 完全比對 (exact matching) 圖形比對 (graph matching) 不完全比對 (inexact matching) 圖同構 (graph isomorphism) 子圖同構 (sub-graph isomorphism) 加權圖比對 (attribute graph matching) 加權子圖比對 (attribute sub-graph matching) 圖 2-8 圖形比對的分類。

20

2.4

骨架化與骨架樹

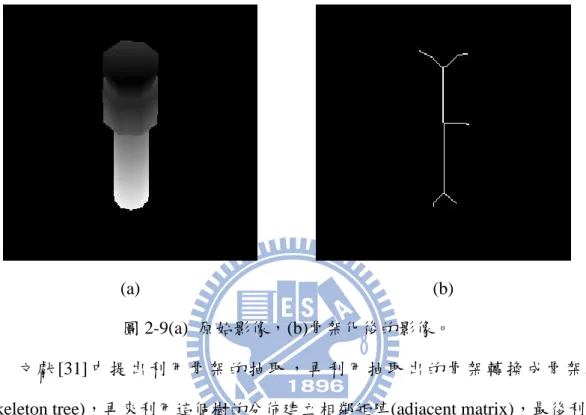

骨架化(skeletonization)為一種將物體做細線化的表現,其中骨架亦可保留物 體的拓樸特性,由文獻[13]利用中軸轉換將物體做細線化,由圖 2-9(b)可以得知 物體做骨架化後所得到結果。 (a) (b) 圖 2-9(a) 原始影像,(b)骨架化後的影像。 文獻 [31] 中提 出利 用 骨架的 抽取 ,再 利用 抽取出 的骨 架轉 換成 骨架樹 (skeleton tree),再來利用這個樹的分佈建立相鄰矩陣(adjacent matrix),最後利用 支持向量機(support vector machine)來對物體做辨識,首先骨架化的方法目前可利 用距離轉換(distance transform),或是細線化(Thinning),亦或是利用中軸轉換來 達成骨架化的方法,再來就是建立骨架樹,在建立骨架樹之前必頇先得到骨架的 終點(endpoint)與接點(crossing point),由圖 2-10 即表示利用圖 2-9(b)中之骨架所 得到的終點與接點,藍色實心點表示接點,綠色實心點則表示終點。21 其中節點 A、B、C 為接點,節點 D、E、F、G、H 為終點,終點與接點都找出 後接下來就是建立骨架樹,樹必頇要有根(root)做為起始節點,而文獻[31]中利用 每個節點中的座標位置距離物體重心的座標位置最接近者做為骨架樹的根,由圖 2-10 的例子中節點 B 的座標為最接近物體重心的座標,接下來就是由節點 B 開 始長出骨架樹的表示,圖 2-11 表示利用圖 2-10 所抽取出的骨架樹。 圖 2-11 骨架樹的表示。 當骨架樹抽取完成後,接下來就是進行相鄰矩陣的計算,相鄰矩陣表示的即為節 點與節點的連接情況,利用一個矩陣來表示,若是兩個節點相鄰,且兩節點不為 同一個節點,則在矩陣中表示為 1,其它則為 0,接下來就是場景節點與模型節 點要如何作匹配,在文獻[31]中節點的匹配則是利用該節點的所對應的子樹所產 生的相鄰矩陣,利用這個相鄰矩陣的特徵值做為量測場景圖與模型圖兩個圖中節 點的相似程度,而圖中的邊則是利用一維的函數 f(r),其中 r 來為變數。若是 m 表示為 f(r)的平均(mean)可由(2.26)式來表示: l i i i r f r m 1 ) ( , (2.26) l i i n i n r r m f r 1 ) ( ) ( ) ( (2.27) 由式(2.27)則為矩(moment)的表示,在 n=2 時廣義的來說為一個點集的形狀的量 測,通常廣泛的被表示成是寬度(width)的測量,而這個函數 f(r)則可以利用節 點與節點間的骨架連接來表示,如此一來節點與節點的連接方式不會是直線,而 是曲線,這樣更能夠表示連接的關係。

22

2.5

點特徵直方圖(point feature histogram)

特徵向量可以利用簡單的平面法向量來組成複雜的特徵向量表示,目前有法 向 量 的 量 測 (surface normal estimation) 與 點 特 徵 直 方 圖 量 測 (point feature histogram estimation),圖 2-12 表示法向量的量測。 圖 2-12 法向量的量測。 法向量的量測做為特徵的表示是最簡單的方式,但若是要利用法向量組合成更複 雜的特徵表示,目前[32]所提出之點特徵直方圖即是目前最新的方法,針對每一 組點對(point pair),(ps,ns);(pt,nt) 且令un、s v(pt ps)u、wuv,圖 2-13 表示選取鄰近點的結果。 圖 2-13 抽取特徵點,選取點對示意圖。紅點為域抽取特徵的點,水藍為半徑 r 內的點,其餘為半徑外的點。

23

j j i j i j i j j n u n w a f p p f p p p p u f n v f , , , tan / , , 3 2 1 0 x x x x x x hist d f f d f i 3 0 min max (2.28) 式(2.28)表示利用圖 2-14 幾個角度的四種函數。 圖 2-14 PFH 特徵抽取角度示意圖。 圖 2-15 為對不同平面抽取 PFH 的結果,可以發現到,PFH 針對不同平面所抽取 出的結果有著顯著的差異,所以對不同平面的分類效果,是可以被期待的,這樣 的 特 徵 在 對 相 似 性 較 高 的 模 型 , 相 信 是 一 個 有 鑑 別 度 的 描 述 子 。 圖 2-15 針對不同平面抽取 PFH 的結果。24

第三章 系統流程

本章總共分成 4 節,首先說明整體辨識的系統流程,再對其辨識流程做進一 步詳細的說明。3.1 節介紹整個三維物體辨識的系統架構應用在塔台的辨識上; 3.2 節說明如何定義在塔台與雷射測距儀在何種距離的情況下要切換辨識策略; 3.3 節說明在距離足夠遠時切換到距離影像的辨識流程,3.4 節說明在距離足夠近 時切換到點雲資料的辨識流程。3.1 整體辨識架構

本論文提出一個辨識法則,採用整合型的方式來達成辨識的目的,本論文的 辨識系統是架構在利用模擬雷射測距儀拍攝物體的方式得取所需之資料然後進 行辨識,而本論文則是利用機場塔台模型來做辨識演算法的驗證,由於是模擬的 方式,故只針對單一物體來做辨識,而非複雜場景的情況下來做,所以不需再對 場景做分割的前處理及去雜訊的動作,本論文在利用模擬雷射測距儀的方式可同 時取得的資料共有兩種,一是點雲資料,二是距離影像,而這兩種資料型態本論 文會根據在塔台與雷射測距儀的距離不同下進行不同的辨識策略,以下章節將詳 細介紹流程圖中每一個方塊的細節。 點雲資料 距離影像 根據雷射測距儀與塔台 的距離做辨識策略切換 採用點雲資料作 為辨識的資料 採用距離影像作 為辨識的資料 距離足夠近 距離足夠遠 辨識結果 輸出 圖 3-1 辨識策略流程圖。25

3.2 辨識策略的切換

本論文在辨識策略的切換是依據物體與雷射測距儀的距離來做切換,故當物 體與雷射測距儀的距離足夠遠時,則可擷取到完整的距離影像如圖 3-2(a)所示, 而對應的影像輪廓是能夠保持封閉的狀態如圖 3-2(b)所示,但如果物體與雷射測 距儀的距離足夠近時,在距離影像的擷取上就無法呈現完整的影像如圖 3-3(a)所 示,而對應的影像輪廓的就無法呈現封閉的狀態如圖 3-3(b)所示,故本論文將依 據影像輪廓的封閉與否來決定要使用哪種資料型態以及進行哪種的辨識策略。 (a) (b) 圖 3-2 距離影像的表示(a)完整的距離影像,(b)封閉的輪廓。 (a) (b) 圖 3-3 距離影像的表示(a)部份的距離影像,(b)不封閉的輪廓。26

3.3 距離影像的辨識

本節討論在塔台與雷射測距儀的距離足夠遠的情況下可以擷取到完整的影 像資訊,本論文將採取距離影像作為辨識時所使用的資料,圖 3-4 當輸入資料為 距離影像下的辨識流程架構。 特徵抽取(傅立 葉描述子) 對每個塔台建 立特徵資料庫 輸入距離 影像 特徵資料庫 離線架構 在線架構 輸入距離 影像 相似度比對 特徵抽取(傅立 葉描述子) 輸出比對結果 視角內插法 圖 3-4 輸入資料為距離影像的辨識流程圖。3.3.1

特徵抽取(傅立葉描述子)

為了要能夠抽取傅立葉描述子,必頇把 3D 模型轉成距離影像,如圖 3-5(b) 所示,在本實驗中拍攝時所使用的解析度為 256*256 像素,要對距離影像作傅立 葉描述子特徵抽取前,必頇先將找出距離影像的輪廓如圖 3-5(c)所示,之後再以 輪廓上每點到中心點的距離為傅立葉參數,經過傅立葉轉換,計算出傅立葉描述 子的特徵值。27

(a)

(b) (c) 圖 3-5 輪廓抽取的過程(a)3D 模型,(b)對應的距離影像,(c)對應的輪廓。 本論文在離線架構下所需之特徵資料庫則是將角度分成 288 視角來進行拍 攝的動作,圖 3-6 表示本論文定義拍攝角度的變化,而這 288 個距離影像經由特 徵抽取後,每個塔台模型都會擁有 288 組傅立葉描述子的特徵向量由圖 3-7 所示, 其中F 至1 F288表示各個不同角度下所產生傅立葉描述子的特徵向量。 圖 3-6 角度表示圖。

28 圖 3-7 特徵資料庫中某一個模型所含的傅立葉描述子的特徵向量之示意圖。

3.3.2

相似度比對

本論文於在線架構下則是利用標高角(elevation)介於 10~80 度與方位角 (azimuth)介於 10~360 度中隨機挑選一組角度來做為輸入距離影像的取得,然後 再經由特徵抽取後可得到一組傅立葉描述子的特徵向量,場景的輸入距離影像所 得之特徵向量要與資料庫中的特徵向量做比對時,本論文在此比較三種範數 (norm),目的在於比較這三種範數對於兩個特徵向量比對的差異度,在比對中則 是希望將像與不像在相似度上做個明顯的區隔,圖 3-8 表示利用 1-norm 應用在 塔台邊號 1 到 10 的相似度比較中,圖 3-9 表示利用 2-norm 應用在塔台邊號 1 到 10 的相似度比較中,圖 3-10 表示利用無限(infinite)-norm 應用在塔台邊號 1 到 10 的相似度比對中,若是這兩個特徵向量越接近則差異度越小,反之則越大,在圖 3-8 至圖 3-10 所使用的場景輸入皆為為塔台編號 10 的某個角度下所拍攝的影像, 然後再與 10 個塔台做相似度比對,從圖 3-8 中明顯可看出利用 1-norm 可以將其 不相似度值做明顯的區隔,而圖 3-9 與圖 3-10 則分別使用 2-norm 與 infinite-norm 並無法有效的區隔不相似度值,所以本論文將採用 1-norm 做為相似度比對時所 使用之比對方法,而在本論文中的特徵資料庫共有 10 個塔台模型,在從中找出 最小的值所對應的塔台模型作為最終的比對結果,本論文利用 Tou[30]提出之動 態最佳分群法(Dynamic Optimal Clustering)來對上述使用三種不同的範數時,對 於分類結果的效能評估,在此本論文直接對每個塔台在每一個固定的距離下都拍 攝 100 張,距離變化從 600 公尺到 1100 公尺做比較,式(3.1)表示效能估測的依29 據, } max{ } min{ ) ( kk ij c D D K , (3.1) 其中 2 1 1 2 ) ( ) ( )) ( ) ( ( N n i j ij z n z n D , 2 1 ) ( 2 ) ( ) ( ) ( ) ( 1 k x class k q kk q z x k n D .則當效能估 測值(Kc)越大表示效能越好,圖 3-8 表示當利用三種不同範數的情況下,各種 不同的範數所做出之效能評估,實驗比較後發現 2-norm 的效能比起其他兩種範 數來的良好。

1-norm 2-norm Infinite-norm 600 公尺 0.1638 0.1758 0.1747 700 公尺 0.1532 0.1535 0.1529 800 公尺 0.1565 0.1566 0.1564 900 公尺 0.1469 0.1474 0.1473 1000 公尺 0.1520 0.1566 0.1546 1100 公尺 0.1497 0.1500 0.1485 圖 3-8 在 6 個距離下,三種不同範數的比較。

3.3 視角內插法

若單純只利用相似度比對之最相像者,作為最後辨識出的塔台,當資料庫含 有更多塔台模型時,這樣有可能就會產生很多相似度最高但卻不是對應到場景的 塔台,這將導致辨識結果下降,故本論文提出視角內插法提高了辨識的準確度, 利用這個內插法做補償可以還原可能的場景拍攝角度,視角內插法可以更進一步 的得到更相似於場景拍攝時的影像,如此一來可以增加辨識時的準確度,圖 3-9 為視角內插法的流程架構。30 挑出候選模 型 找出候選模型的 角度落點範圍 找出內插後的特 徵(傅立葉描述子) 進行比對 圖 3-9 視角內插法流程圖。

3.3.4

挑出候選模型

首先將場景的距離影像與每一個塔台模型進行相似度比對,而一個塔台會產 生一組 288 個的比對結果,本論文稱之為 dissimilarity between nodel and scene(簡 稱 DMS)如圖 3-10 所示,表中每一格 Dis 則表示經過相似度比對後所產生的差異 度,再將這個 DMS 利用直方圖的方式來呈現如圖 3-11 所示,針對 10 個塔台挑 選出前幾名差異度最小的作為候選模型,而如何得到最小的差異度則是依據圖 3-10 所圈出的直方圖所對應的差異度,本論文則是針對 10 個塔台模型找出前幾 名差異度最小的作為候選模型,而表中被圈出的部份則由下一節來說明。 圖 3-10 場景與資料庫的特徵向量經由比對後所產生的結果之示意圖。31 圖 3-11 直方圖表示對應的範圍。 本論文設定一個門檻值,當直方圖中的差異度小於門檻值,則所對應的值方圖將 被挑出來做為角度落點範圍的依據,圖 3-11 中紅色區塊則是差異度小於門檻值 所對應的值方圖。

3.3.5

找出候選模型的角度落點範圍及內插角度

圖 3-12 被圈出的區塊則是應對於圖 3-11 直方圖中差異度小於門檻值的部份, 由於在場景拍攝時是隨機拍攝,我們並不知道是在甚麼角度下去拍攝的,所以由 這些紅色區塊的分佈我們反推對應於場景拍攝時可能的角度範圍,每一個區塊可 看作是一個群集,圖 3-12 說明如何利用這些區塊中心做為內插角度的挑選。 圖 3-12 每個群集中心對應新的內插角度示意圖。 門檻值32

3.3.6

找出內插的影像及計算傅立葉描述子

利用每個群集中心找出每一個候選模型的內插角度後,每一個候選模型都會 算出所屬的內插角度,接下來就是利用內插角度取出鄰近的距離影像的特徵向量, 最後就是對這些距離影像的特徵向量作內插,圖 3-13 為內插之流程圖。 圖 3-13 內插的流程 先得知後選模型有哪些,利用用新的內插角度得知鄰近四張影像的特徵向量, 在視角內插的部分,本論文利用雙線性內插法(bilinear interpolation),將其四張影 像的特徵向量做內插,最後可得到內插後新的傅立葉描述子做為特徵向量。3.3.7

進行比對

經由前幾名候選模型所算出之傅立葉描述子的特徵向量將與場景之特徵向 量做比對,比對的方式仍然是採用 2-norm 的方式來算出差異度,最後比對結果 也將採取前幾名差異度中最小的差異度所對應的模型作為最終的比對結果。3.3.8

非資料庫物體偵測

通常進行比對後,不相似度最小的值所對應的物體,即是最後辨識出的物體,33 不過往往辨識出的物體有時候不含在資料庫中,故本論文在此提出一個非資料庫 物體的偵測,利用 10 個模型進行比對後,經由正確比對所產生的大量不相似度 值之資料進行統計,可以得知當場景物體與資料庫模型進行比對後大概的相似度 值會介於在哪一個範圍內,進而可以依據這個範圍的限制,來剃除有可能不是在 資料庫中的場景物體。 圖 3-14 由左至右、由上至下分別為塔台編號 1 到 10,正確比對之對應不相似度 值。 圖 3-15 綜合 10 個塔台之正確比對所對應的不相似度值。

34 為了區別當非資料庫中的物體場景輸入時,本論文採用一個 Z 函數如式 (3.2)。 b x , b x b a , a b b x b a x , a a b a x a x , f ( x , a , b ) 0 2 2 2 2 1 1 2 2 , (3.2) 圖 3-16 Z 函數之分佈情形 由圖 3-16 可以發現,當輸入場景與資料庫比對後,最小的不相似度值若是越大, 則其相似比例將會越來越小,本論文設定當相似比例小於 0.3 時,則本論文將判 斷此輸入場景不是屬於資料庫中任一類模型。 圖 3-17 第 11 類塔台。 圖 3-17 第 11 個塔台模型本論文測詴後發現,將第 11 個塔台與資料庫比對後,

35 最小的不相似度值為 0.18,故相似比例小於門檻值,所以本論文判斷此類為不屬 於資料庫的場景物體。

3.4 點雲資料的辨識

本節將討論在塔台與雷射測距儀的距離足夠近的情況下無法擷取到完整的 影像資訊,本論文將採取點雲資料作為辨識時所使用的資料,在點雲資料的部份, 本論文提出一個結構特徵作為辨識時所使用之特徵表示,圖 3-18 表示當輸入資 料為點雲資料下的辨識流程架構。 特徵抽取(結構 描述子) 對每個塔台建 立特徵資料庫 輸入點雲 資料 特徵資料庫 離線架構 在線架構 輸入點雲 資料 相似度比對 特徵抽取(結構 描述子) 輸出比對結果 圖 3-18 輸入資料為點雲資料的辨識流程圖。3.4.1

特徵抽取(結構描述子)

經由雷射測距儀所取得的點雲資料,雖然在空間中是無序的,但這些點雲的 分佈卻可以表示物體的外型,故將利用這些點雲的幾何分佈來做為辨識時所使用 的特徵,但是當量測的視角不同時,會得到不同的三維物體姿態,所以在特徵的 建立上必頇要滿足,尺度不變性(scale invariant),平移不變性(translation invariant),36

旋轉不變性(rotation invariant ),本論文利用圖(graph)的方式來達到建立結構描述 子作為比對時所使用的特徵表示,建立結構描述子的流程如圖 3-19 所示。 輸入點雲資料 圖形建立(結構描述子) 前處理 計算主曲率 點雲分類 點雲分割 區域成長法 主成分分析 找法向量 圖 3-19 建立結構描述子的流程圖。

3.4.2 前處理

在求得某點 P 之主曲率前,必頇先要得知點 P 之法向量,利用空間中點 P 之 鄰近點,經由 P 點與鄰近點之空間幾何分佈可得之法向量之方向,由主成分分析 法 的 所 找 出 之 三 主 軸 即 為 其 相 關 矩 陣 之 特 徵 向 量{e0,e1,e2}對 應 的 特 徵 值 } , , {0 1 2 ,其中0 1 2,而0所對應的特徵向量e 就是法向量如圖 3-200 所示,而點 P 之主曲率可由 2.3.2 節求得。37 圖 3-20 法向量的表示。

3.4.3

點雲分類

本論文利用 2.3.1 節所介紹之主曲率並歸納出點屬性的分類表格如表 2-1 所 示,根據表 2-1 在點雲的分類上本論文使用兩個門檻值 Thr1 及 Thr2 來區別目前 的點資料是屬於哪種屬性,表 2-1 加入門檻值的限制後修改成如表 3-1 所示。 表 3-1 修改後的點屬性分佈。 2 1and k k 內部點(interior) k1 Thr1andk2 Thr1 邊緣點(edge) 1 1 1 1 2 1 2 1 Thr and k Thr or k Thr andk Thr k 击角點(convex corner) 1 1 2 * 0 2 1 2 1 21 Thr and k Thr andk k Thr andk k

k 凹角點(corner concave) 1 1 2 * 0 2 1 2 1 2

1 Thr and k Thr andk k Thr andk k

k

利用表 3-1 對點屬性的分佈本論文挑選的門檻值 Thr1 = 0.48 及 Thr2 = 0.1 所分後 的結果如圖 3-21 所示。

38 (a) (b) (c) (d) 圖 3-21 點分類後的結果 (a)編號 1 之原始部分點雲資料,(b)圖(a)之分類結果, (c)邊號 10 之原始部分點雲資料,(d)圖(c)之分類結果。

3.4.4

區域分割

在點雲資料做完分類後,可得知每點的屬性,由於區域成長法也適用於高維 度的資料,故本論文應用區域成長法來達到分割每塊不同的平面或是曲面,在區 域成長法中,種子點的選擇有時候會關係到分割效果的好壞,一般而言種子點的 選擇是不希望種子點落在雜訊或是邊界上,但是就目前而言還沒有很好的說明應39 用特定的種子點選擇可以達到最好的分割效果,所以按照不同的問題則會有不同 的種子點找尋的方法,由於本論文在 3.4.2 節已經將每點資料做過分類,所以在 種子點的找尋方面只針對內部點(interior)來處理,在每次新的群集之初始種子點 則是利用隨機的方式在內部點中挑選,而種子點之鄰近點是否屬於同一群集的評 判標準則是利用點與點的法向量夾角小於某個門檻值,點與點的歐基里德距離小 於某個門檻值,收尋的鄰近點中只能是內部點,而區域成長法的流程圖由 3-22 所示。 點雲資料 從內部點隨機挑 選起始種子點 由種子點進行鄰 近點的搜尋 是否每點都尋 訪過 否 非邊緣點 角度<門檻值 距離<門檻值 點合併 成為同一群的種子點 是否還有種子 點 是 否 是 否 是 成長結束 圖 3-22 區域成長法流程圖。 本論文在角度的門檻值是設定 12 度,距離的門檻值是設定 1.3 公尺,圖 3-21 的分割結果如圖 3-23 所示。

![圖 4-13 表示本論文提出的整合型(integrate method)的方法與 G. Hetzel[19]所提出 之方法做比較。](https://thumb-ap.123doks.com/thumbv2/9libinfo/8637124.192927/74.892.147.770.394.823/圖4表示本論文提出整合型integratemethod方法與GHetzel19所提出之方法做比較.webp)