行政院國家科學委員會補助專題研究計畫 □ ˇ 成 果 報 告

□期中進度報告

應用廣視野來源影像

改進網路遙控自走機器人操作介面之研究

計畫類別:□ˇ 個別型計畫 □ 整合型計畫 計畫編號:NSC 94-2213-E-011-057-

執行期間:2005 年 8 月 1 日至 2006 年 10 月 31 日

計畫主持人:鄧惟中 共同主持人:

計畫參與人員:鍾慶彥、施景元

成果報告類型(依經費核定清單規定繳交):□ˇ精簡報告 □完整報告

本成果報告包括以下應繳交之附件:

□赴國外出差或研習心得報告一份

□赴大陸地區出差或研習心得報告一份

□ˇ出席國際學術會議心得報告及發表之論文各一份

□國際合作研究計畫國外研究報告書一份

處理方式:除產學合作研究計畫、提升產業技術及人才培育研究計畫、列 管計畫及下列情形者外,得立即公開查詢

□ˇ涉及專利或其他智慧財產權,□一年□ˇ二年後可公開查詢 執行單位:國立台灣科技大學

中 華 民 國 九十六年 九月 二十九日

摘要

在一般遠端遙控機器人系統的各種感測器資訊裡,視覺回饋是使用者操控時藉以產生空 間臨場感最為直覺的工具。而為了提升使用者控制遠端機器人的效率,各種採用特殊廣 角度鏡頭視覺感測器的機器人視覺系統紛紛被設計出來,以盡可能地取得大量的視覺資 訊 。 然 而 這 些 經 由 特 殊 廣 角 度 鏡 頭 設 計 的 視 覺 感 測 器 卻 會 引 起 影 像 嚴 重 的 畸 變

(distortion),必須採用影像演算法進一步校正畫面後,使用者才得以正常辨認畫面內 容。

本計劃針對遠端遙控機器人的視覺回饋,設計並建構出一套具有廣視野畫面臨場感的系 統。採用三台一般市售網路攝影機(webcam)與兩片反射平面鏡設計組合而成的光學系統,

可達到非同步拍攝具相同視點(point-of-view)但不同視野(field-of-view)的多重畫面;再 交由利用 DirectShow 設計之影像處理 PanMultiCamFilter 整併多視野畫面。本廣視野視覺感測 器搭配可程式化控制馬達,可提供更有彈性之水平視野拍攝範圍,且透過一般網路將廣視野 影像回饋傳送至遠端使用者介面。完成一高臨場感且具低畸變畫面特性之廣視野視覺感測器。

Abstract

Among all sensory data of a remote controlled robot system, visual feedback provides the most straightforward information on constructing spatial presence for users. For the efficiency of controlling remote robots, many visual feedback systems with special wide-angle lenses on cameras were designed to capture massive images. However, these special wide-angle lenses will cause image distortion heavily. Image must be corrected by image processing algorithms before it could be recognized by users.

This project focuses on establishing a visual feedback system which provides wide FOV (field-of-view) presence in remote controlled robots. A new optical system combined with three webcams and two flat mirrors could asynchronously capture multiple images with different FOV from the same POV (position-of-view). These images were then merged and transformed by the PanMultiCamFilter, developed from the DirectShow. By joining a bearing mechanism with a programmable motor controller, the wide FOV visual feedback system could provide more flexible horizontal FOV. Those images captured by the system were transferred to remote user interface (UI)

1. 報告內容

1.1 前言

近十年來網際網路與無線網路的快速發展,帶動了許多結合傳統領域與網路技術的新的 技術分野,其中一個例子便是透過遙控機器人來進行遠隔作業的各種應用。然而當使用 者透過直接操控(direct control)方式操作遙控機器人時,系統必須能夠即時傳送與處 理操作者指令與機器人的回饋資訊,否則操作者在明顯感受到機器人的動作及操作延遲 的情形下,多會改為逐次單一指令的操作方式(move-and-wait strategy)而大幅降低操 作效率[1]。為了提升使用者在操作遠端機器人時的臨場感,最直覺的方式莫過於使用攝 影機提供使用者足夠的視野。無論是單攝影機還是多攝影機組的設計理念,均強調畫面 傳送的即時性,特別是在採用多攝影機組合而成的廣視野畫面系統中更會被突顯出來。

然而現行的視訊系統在製造成本、提供視野之寬度以及解析度方面各有優劣。同時網路 頻寬的不足常限制住了畫面傳送的能力;因此本計劃的遠程目標就是在尋求一個兼顧廣 視野臨場感與平衡網路頻寬的技術。

1.2 研究目的

本研究著重在改善「操控者的視覺體驗介面」。嘗試設計一套遠端機器人的影像伺服系 統,架構上將遠端機器人的影像透過一般網路回饋至本地使用者操控介面顯示。架設於 遠端機器人上的視覺系統採用多重攝影機影像的設計,並採用鏡面組合達到廣視野合成 效果。經由本地操控介面的操作,遠端影像伺服系統可透過快取即時地回饋使用者所需 求的視野範圍;再搭配承載視覺系統的旋轉馬達,進一步提供更寬闊的水平方向視野。

操控者可在不影響機器人行進方向的狀況下任意調整欲觀察之視野範圍進而提升操控機 器人的效率。期望除了能有效使用有限的網路頻寬外,還能兼顧影像品質與即時性的需 求。

1.3 文獻探討

目前最先進的遠端遙控機器人操作系統,應該是由日本經濟產業省在 1998 所推動的 HRP

(Humanoid Robotics Project)計畫[2]。該計畫中的研究利用 Honda 製造的 P3 人型機 器人進行遠端遙控感測,本地駕駛員座艙中負責連結遠端機器人雙臂的操縱桿可輸出全 自由度的移動指令,遠端機器手臂先端的受力與機器人步行時的震動均會透過力回饋裝 置輸出到操作者身上。並於本地駕駛員座艙正前方架設組合式多面體投影幕,將遠端機 器人頭部攝影機拍攝的立體畫面投射到投影幕上形成一水平達 150 度、垂直達 117 度的 廣視野影像[3][4]。2001 年日本築波大學岩田・矢野研究室針對 HRP 視覺系統利用立體 投影幕的想法,將原固定式多面體投影幕改良,成為可在固定之圓形軌道上滑動,再加 上 9 台 CCD 攝影機元件,使攝影機組擷取影像投射至多面體投影幕,組成一水平達 136.2 度、垂直達 104.4 度之廣視野視覺系統(一般人類最大的水平視角達 200 度,垂直視角 達 120 度)[5]。

一套遠端遙控機器人系統,技術領域涵蓋了機器人學、遠端遙控、感測器系統以及人機

介面的範疇[6];而本研究系統著重在應用於遠端遙控機器人之視覺感測系統。

1.4 研究方法

1.4.1. 硬體

發展目標在於整合遠端遙控機器人系統中之必要模組,且針對視訊回饋的部份特別設 計並架設客製化硬體。

1.4.1.1. 已建置內容

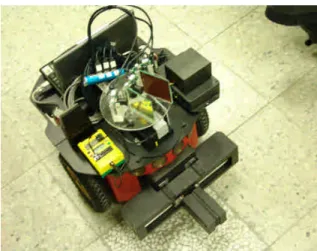

機器人硬體部份採用的是 Activemedia Pioneer 3 mobile robot 為實驗平台,並於 Pioneer 3 上配置由三顆 Logitech QuickCam Pro 4000 網路攝影機組合而成的影像擷取攝影機 組,攝影機組與 Pioneer 3 之間的旋轉馬達支軸採用 Lego 挑戰計畫組的積木建構;馬 達旋轉訊號的傳遞使用 Lego Mindstorm RCX command center 控制器來下達指令。硬體 部分完成後如下圖一:

圖一 廣視野遙設系統安裝於行動機器人 P3-DX 1.4.1.2. 如何建置

Acrivemedia Pioneer 3 為既有之 mobile robot 實驗平台,故實驗硬體設計重點在於影像 擷取攝影機組的建置上。攝影機元件採用一般常見的市售網路攝影機進行組裝(型號:

Logitech QuickCam Pro 4000)。為求得在多部攝影機畫面中,無論視線朝向何方,畫面 中心原點均能保持不動;因此設計出利用鏡面反射原理之影像擷取攝影機組,如下圖

圖二 網路攝影機鏡組設計圖[7]

考慮到攝影機組的整體大小應盡量精簡的原則,與實際上 mobile robot 實驗平台所能負 荷的掛載物體積大小;從而歸納出一套公式,僅須考慮鏡面擺設角度與鏡面積之關係,

如此可有效降低鏡組設計的重量負擔與體積大小:

r

m

]1 ) 90 sin(

sin 2 sin [ sin

在承載攝影機組的圓盤下方設置了一組馬達,採用樂高積木-挑戰計畫組(9794 -Team Challenge Set)為基底,並撰寫程式透過可程式控制積木(RCX command center)來控 制圓盤馬達之作動,賦予了攝影機組能進行水平搖攝(pan)的能力。

1.4.1.3. 建置成果與難題

操作者可透過介面控制旋轉馬達,使廣視野攝影機組能進行左右各九十度的水平搖 攝。但由於傳輸馬達指令的裝置乃是採用紅外線傳輸的方式,再加上 RCX command center 控制器本身並無指令堆疊的能力,因此使得指令與指令之間的延遲特別明顯。

此外必須再進一步從軟體層面下手,透過使用者的視野操作意圖訂立門檻值,超出視 野門檻值就預先使攝影機組轉動,期望能大幅降低指令傳輸的延遲影響。

1.4.2. 軟體

發展目標在整合本地多攝影機影像來源之畫面,使其成為一擁有共同視野中心之廣視 野畫面;並加入透過網路遞送影像之能力,實現遠端遙控機器人操作環境中視覺回饋

r:鏡組半徑規模大小

m:鏡長 可導出鏡面積(重量)

α:攝影機之視角 β:折射鏡面之夾角

的模組。

1.4.2.1. 已建置內容

影像整合之核心部份,採用 Microsoft DirectShow 技術,完成一 transform filter –

“PanMultiCAM filter”。此 filter 支援:

1. 水平搖攝模擬-可以有段或無段式來模擬攝影機水平左右搖攝。

2. 多攝影機影像來源-可接兩台以上支援標準 WDM(Windows Driver Model)或 VFW

(Video for Windows)驅動格式之不同廠牌 USB 攝影機。

1.4.2.2. 如何建置

為了能確切掌握多攝影機之影像畫面接合以及減少影像處理的資料流程,我們排除由 Sun 公司開發的 JMF(Java Media Framework)技術,避免在 JVM(Java Virtual Machine)

平台上執行效能不彰的影響。

DirectX 是 Microsoft 在 Windows 平台上提供發展高性能圖形、聲音、輸入、輸出以及 網路遊戲的一套 API。透過 DirectX API 所提供的介面,開發人員可以盡情地使用硬體 可能帶來的高性能,而無需關心硬體的實際執行細節。此外,DirectX 採用了 COM

(Component Object Model)標準,使得開發 DirectX 的程式就如同開發軟體 IC 般具 有動態替換程式模組元件的能力,同時用戶端程式與 COM 元件之間的溝通也能遵循 共同的合作標準。

本系統核心部份主要採用 Microsoft 的 DirectShow 技術,DirectShow 為 DirectX 下專為 Windows 平台上專為處理各種格式的媒體文件播放、影音視訊擷取等高性能要求的多 媒體應用成員。DirectShow 使用 Filter Graph 的模型來管理整個媒體資料數據的處理過 程,參與媒體數據處理的各個功能模組叫做 filter,而各個 filter 在 Filter Graph 中按一 定的順序串連起來成為一條處理媒體資料的 ”流水線”。

一般 filter 分成三大類:Source Filters、Transform Filters 和 Rendering Filters。Source Filters 主要負責獲取媒體樣本數據,媒體來源可以是本地或是 Internet 上的文件、視訊擷取卡 或是網路攝影機(遵循 WDM 或 VFW 驅動格式的硬體),然後將媒體樣本數據往下傳 輸。Transform Filters 主要負責媒體樣本數據的格式轉換,像是影像與聲音頻道的分離 或是合成、解碼或是編碼等等,然後將媒體樣本數據繼續往下傳輸。Rendering Filters 主要負責媒體樣本數據的最後呈現,將數據送給顯示卡或是音效卡,進行多媒體的播 放或是輸出成檔案進行儲存。

圖三 DirectShow 系統綜覽

每個 filter 必定具有輸出或輸入的接口(pin);提供媒體來源的 Source Filters 沒有上一 級的輸入資源,所以 Source Filters 僅具有單一或多重輸出接口(input pin)。Transform Filters 乃是完成數據格式轉換的模組,因此 Transform Filters 同時具有用以接收來自上 一級輸入媒體資源的輸入接口,與負責傳送處理完畢之媒體資源到下一級演示媒體的 輸出接口。最後只需負責演示媒體資料的 Rendering Filters 由於不需再傳遞媒體資料到 下一級 filter,因此只具有單一或多重輸入接口。

從實做的層面來說,上述三大類 filters 之架構與功能由 DirectShow SDK 中三類基本物 件類別完成之:CSource 物件類別對應到 Source Filters,CTransformFilter 物件類別對 應到 Transform Filters,CBaseRenderer 物件類別對應到 Rendering Filters。因此我們按 照既定目標,依序建置以下幾類應用 filters:

PanCAM filter-模擬網路攝影機畫面的水平搖攝

為了模擬 PTZ 攝影機畫面的水平移動功能,避免遊於機械轉動帶來的傳輸延遲,我們 進行水平搖攝功能的開發。水平搖攝本身不牽涉到影像輸入與輸出顯示,僅需針對影 像 本 身 內 容 做 修 改 ; 因 此 利 用 CTransformFilter 物 件 類 別 的 特 性 , 針 對 內 部 CTransformFilter::Transform ()函式進行細部客製化設計。Microsoft DirectShow 的媒體 類型定義可分為兩大類-有 subtype 與沒有 subtype,其中由網路攝影機所擷取的影像 媒體類型屬於 MEDIATYPE_Video,具有可再細分的 subtypes,此處不再詳述。

在此我們處理的攝影機媒體格式是 MEDIASUBTYPE_RGB24,即是以點陣圖影像格式 的內部型態存在,可以對每一幅影像中的任意點(pixel)進行著色。因此我們採取的 快速作法就是將每一個點的 RGB 資料複製到平移距離的相對應點,再將平移的區塊著

黑色,如圖四所示。整合後之影像與攝影機控制介面請見圖五。

圖四 平移畫面來源以便合成影像

MultiCAM filter-支援多網路攝影機影像輸入訊源

完成畫面平移之功能後,再考慮由多攝影機組構成的廣視野畫面;第一件事就是必須 先建構能接收多台攝影機畫面的 filter 後,才能再進一步對接收到的多台攝影機畫面做 影像合成與輸出;由於 PanCAM filter 是繼承 CTransformFilter 物件類別之既有架構,

只允許有單一輸入接口與單一輸出接口,因此我們採用能自由定義輸入與輸出接口數 量的 CBaseFilter 物件類別作為開發目標的母類別。先定義此 MultiCAM filter 擁有多重 輸入與輸出接口的物件串列,接著在 Filter Graph Manager 完成 MultiCAM filter 的一根 輸入接口與上一級攝影機媒體來源 filter 的輸出接口相連接後,立即動態配置記憶體,

生成一根新的輸入接口;當斷開 MultiCAM filter 已連接的輸入接口時,亦會立即釋放 掉該輸入接口的資源。這樣的設計擁有可動態連接攝影機媒體來源 filter 的彈性,但缺 點是必須保證輸入接口的媒體來源格式(main media type 與 sub media type)一致才能 順利連接。

為了簡化下一級演示媒體資料的過程,我們設計 MultiCAM filter 僅有一個輸出接口;

來自每一輸入接口的各台攝影機畫面將不經修改,直接送往輸出接口供給下一級 filter 處理(圖六)。

圖六 MultiCAM filter 連接多台攝影機

整合 PanCAM filter 與 MultiCAM filter 為 PanMultiCAM filter

回到目標系統中,多台攝影機畫面的接合工作同時需要內部平移畫面的能力與連接外 部多台攝影機畫面的架構,於是開始著手整合這兩種能力到一個 Filter 內。我們的實 作策略是利用設計完成的 MultiCAM filter 架構來改善 CTransformFilter 原生架構,使 其超越單一輸入、輸出接口的限制;同時修改 PanCAM filter 模組架構,並繼承改良後 之 CTransformFilter 物件類別,最後可得到一支援多攝影機影像來源的水平搖攝模擬 filter。

1.4.2.3. 建置成果與難題

透過兩類子系統的開發與整併,我們建置了機器人系統中的核心視訊回饋模組。目前 實驗設計中僅連接三台網路攝影機,因此我們可透過 PanMultiCAM filter 得到由三台 攝影機擷取畫面組成的單一廣視野影像,其視角可達到 42*3=126 度的效果。另外,本 視訊回饋模組無需特殊硬體平台支援,可由一般市售、合於基本 WDM 或 VFW 驅動 格式之網路攝影機連接組合完成。

開發過程中,首先面臨到的問題就是 COM 軟體技術的掌握,以及 Microsoft DirectShow 的各類 filter 元件特性與媒體資料的流動技術。每個 filter 都是一個 COM 元件,每一 個媒體數據樣本也都是一個 COM 元件,元件與元件之間的溝通透過互相叫用彼此的 介面(interface)來完成。每個 COM 元件的生命週期,隨著自身介面被查詢使用時而 增加,也隨著外部查詢完畢的釋放介面而減少;當沒人參考到這 COM 元件時,該 COM 元件將自動自我銷毀。因此,想要正確的連接每個 filter(COM 元件),就必須精確的 掌握每個 Filter 提供的介面,是何時、何者、如何去查詢調用它的。由於相關技術資 料不易取得,因此這些經驗(know-how)的累積花了許多時間。

1.5 結果與討論

本研究成功地實作出一應用於遠端遙控機器人之廣視野影像攝影系統。比較不同的視覺 感測系統種類,會發現使用單攝影機雖然輕薄短小,但取得畫面資訊過少不易觀察;改 良使用廣角鏡頭與全向攝影機取得超寬廣視野卻又會引發必須修正的畸變問題。本研究 系統採用組合平面鏡與一般單鏡頭攝影機的結構克服曲透鏡光學設計上的畸變,並保有 同一 POV 下之廣視野臨場感。在軟體方面則開發出取得攝影機拍攝畫面後之影像處理程 序,從單台攝影機畫面的水平搖攝處理,支援多台攝影機之架構,到最後循序漸進突破 DirectShow 之 filter framework,設計出有效率且能與多攝影機搭配的影像處理核心-

PanMultiCamFilter。接著增加的使用者介面則將使用者任意觀察視野範圍的能力延伸到 遠端機器人上。最後考慮可視範圍的彈性,我們也將 Lego 控制系統與步進馬達加入本研 究之視覺感測系統中,使得搭載本廣視野影像回饋系統的遠端遙控機器人,在使用者可 操作機器人進入的空間內任意地探索。

後續的工作可分作以下數個方面考量:

使用者介面與遠端視野臨場感對應模型之研究:考慮使用者操作系統時,其心智模 型與系統之視覺回饋如何相對應,是否能透過使用者介面的改良提升使用者操作系

軟體的影像處理技術,以及其應用的範圍用途,...等;均累積了許多前人當代創新的研 究才得以發展出現在的規模。或許在不久後的未來,透過機器人視覺回饋,人類能進步 到「能張目對日,明察秋毫」的境界。

2. 參考文獻

[1]Bob Ricks, et al, Ecological Displays for Robot interaction : A new Perspective, International

Conference on Intelligent Robots and Systems (IROS), Vol. 3, 2855-2860, 2004.

[2]Humanoid Robotics Project - 人間協調・共存型ロボットシステム, July 2007,

<http://www.mstc.or.jp/hrp/main.html>.

[3]Takashi Nishiyama, Hiroshi Hoshino, Kenshi Suzuki, Ryoji Nakajima, Kazuya Sawada and Susumu Tachi, Development of Surrounded Audio-Visual Display System for Humanoid Robot Control, International Conference on Artificial Reality and Telexistence(ICAT), 1999.

[4]Susumu Tachi, Kiyoshi Komoriya, Kazuya sawada, Takashi Nishiyama, Toshiyuki Itoko, Masami Kobayashi, Kozo Inove, Telexistence Cockpit for Humanoid Robot Control, Advanced Robotics, Vol.

17, No. 3, 199-217, 2003.

[5]続元宏, 岩田洋夫, 旋回式高解像度実画像ディスプレイ, 日本バーチャルリアリティ学

会第 6 回大会論文集, Sep 2001.

[6]T. Sheridan, Telerobotics, automation and human supervisory control, Cambridge, MA, MIT

Press, 1992.

[7]鍾慶彥, 廣視野視訊回饋應用於遠端機器人遙控系統之生成策略, 國立台灣科技大學, 碩

士論文, 2005.

[8]LEGO Education, Team Challenge set with USB transmitter, July 2007,

<http://www1.lego.com/education/default.asp?l2id=0_1&page=7_1>.

3. 計畫成果自評

本計畫成功建置廣視野影像攝影系統之軟硬體設備一套,並將成果發表於日本虛擬實境大會:

Wei-Chung Teng and Ching-Yuan Shih,“An Approach to CompensateVideo Feedback Delay of TelepresenceSystemsby Utilizing WideField ofView Video Source”,Proceeding of the Virtual Reality Society of Japan 11th Annual Conference, Sep. 2006.

在整合複數網路攝影機之影像訊號時,我們選擇使用 Microsoft DirectShow 技術來開發軟體,

卻未料到論及 DirectShow 的各類 filter 元件特性與媒體資料的流動技術之技術文件均未談到 整合複數影像來源之作法,雖然最後自行以試誤法成功完成軟體系統,卻花費了比計畫當初 所提出之時程還長的時間,是以後應檢討之處。

日本バーチャルリアリティ学会第 11回大会論文集(2006年 9月)

広視域ビデオ源によりテレイグジスタンスシステムに おけるビデオフィードバック遅延の改善法

An Approach to Compensate Video Feedback Delay of Telepresence Systems by Utilizing Wide Field of View Video Source

鄧惟中,施景元 Wei-Chung Teng and Ching-Yuan Shih

台湾科技大学 資訊工程系(情報工学系)

(〒106 #43,Sec.4,Keelung Rd., Taipei, Taiwan, [email protected])

Abstract: One of the bottlenecks in telepresence systems is that only limited size of video feedback allowable due to communication bandwidth restriction. A PTZ camera partially solves this problem by providing pan and tilt freedom. However, the extra instructions on camera and bigger time delay jitter introduce more issues to solve. In this paper, an approach utilizing wild FOV video source is developed to compensate time delay from motion lag of PTZ camera and to aim on clearer image when the operators changes his/her view. A mobile robot equipped with multiple cameras arranged in a circular fashion is used for demonstration.

Key Words: telepresence, video feedback, field of view.

1.Introduction

A prerequisite for telepresence systems, or telexistence systems, is that the teleoperator be directly and continuously controlled by human in real-timefashion.Sincehumanoperatorsmayonlyknow remote environment via sensory feedback from remote site,it’s obvious that system designer should make sure the operator receives real-time sensory feedback of remote environment as muchas possible.It’swell known that video feedback is much important than other sensory feedback, yet ironically enough this video feedback usually suffers the highest time delay and with highly restricted field of view (FOV) due to communication bandwidth limit[1].

In the last decade, we observedmany mobile vehicles equippedwith onlyonecamerawhichprovides about 38

to the operator, and time delay jitteralso grows during the rotating period due to camera’s motion lag. To compensate the hazard comesfrom rotate operation on camera,weproposeanapproachutilizingwildFOVvideo source. The idea is to let the robot equipped with superfluous cameras directing to non-overlapping angles of view, and only the part asked by human is transmitted.

2.Design of a Wild FOV Video Source 2.1Web Cameras with Mirrors

Thereare manypossible waystofetchawild FOV video source,but most of these methods required expensive devices.Herewepresentasimpleandlowcostdesign for a wilder video source.

Our origin idea is to arrange all cameras in a

andm be the length of mirrors, than we have

sin( )

) cos(

cos sin

r

m

(1)This methodprovides aneffectivethreecamera wild FOV.Andalthoughit’sdifficulttoextend thecamera’s number currently, the FOV wehave now is sufficient to implement the experimental platform.

3.Developing Video Stream Server

Figure 2 demonstrates the softwarearchitecture of video streaming subsystem, for both server site and client site. All blocks in figure 2 stand for implementedclasses inheritedfrom DirectShowfilter classes.TheNRLVideo Assemblerclass, implementedas a transform filter, isin chargeof combining desired angles of view from video signal of the three cameras.

Inourexperimentalsystemthecombinedscreenisin defaultasbigas one camera source, but the sizeis adjustable. Since the transferred information is no more than one camera video, human operators feel no

difference with other mobile vehicle, but he/she may always acquires interesting angleof view in realtime aslong asitisincludedinthewildFOVvideo source.

4.Experimental Platform

Figure 3 shows the experimental platform for our approach.The proposedvideosource deviceis fixedon a circular plastic disk, with all three cameras connectedtoanotebookusingUSBcables.Theyellow controller provides rolling function to the plastic disk,which isforfuture research.All these devices are carried by Pioneer 3DX mobile vehicle and participantscontrolitviamobilenetworkconnection.

5.Conclusion

In thispaperwe presentedan effectivewayto shorten the response time of normal PTZ camera equipped in mobile robots by utilizing awild FOV video source and a software video assembler. Asimpleandlow costdesign forthreecamera wild FOV video sourceis also proposed.

Acknowledgement Thiswork issupported bytheNational Science Council of the Republic of China, under the grant NSC 94-2213-E-011-057.

References

[1]T. Sheridan, “Telerobotics, automation and human supervisory control,” Cambridge, MA: MIT Press, 1992.

[2]S. Hughes, et al., “Camera Control and Decoupled Motion for Teleoperation”, Proc. 2003 IEEE Int’l Conf.Systems,Man,and Cybernetics,IEEEPress, pp.1339–1344, 2003.

Figure 1 A three camera wild FOV utilizing two mirrors

Figure 2 Software architecture for video stream transmission

Figure 3 A PIONEER 3-DX equipped with wild FOV video source

可供推廣之研發成果資料表

■ 可申請專利 ■ 可技術移轉 日期:96 年 9 月 29 日

國科會補助計畫

計畫名稱:應用廣視野來源影像改進網路遙控自走機器人操作介面 之研究

計畫主持人:鄧惟中

計畫編號:NSC 94-2213-E-011-057 學門領域:資訊學門二

技術/創作名稱 廣視野影像攝影系統 發明人/創作人 施景元、鄧惟中

技術說明

中文:本技術硬體方面採用一般網路攝影機與反射平面鏡設計組合 而成,可達到非同步拍攝具相同投影中心但不同視野的多重畫面。

且依據反射定律,針對攝影機與反射鏡面的擺設方式進行設計,可 將攝影機擷取影像排列成一類似全景之畫面。完成一高臨場感且具 畫面低畸變特性之廣視野視覺感測器。

英文:This new visual system combined with webcams and flat mirrors could asynchronously capture multiple images with different FOV (field-of-view) from the same center of projection. And according to law of reflection, captured images could be aligned into a panoramic image. At the end, a wide FOV visual feedback system was created with high presence and low image distortion.

可利用之產業 及 可開發之產品

以畫面錄像為基礎之監控系統,如 IPCam。

本技術雛型在畫面上可取得比單一廣角鏡頭還寬廣之視野範圍,運 算時間上低於全向攝影機必須採用複雜影像投影計算之時間。並以 附件二

※ 1.每項研發成果請填寫一式二份,一份隨成果報告送繳本會,一份送 貴單位研 發成果推廣單位(如技術移轉中心)。

※

2.本項研發成果若尚未申請專利,請勿揭露可申請專利之主要內容。※ 3.本表若不敷使用,請自行影印使用。